語言模型

」 AI 人工智慧 輝達 ChatGPT OpenAI

台積電也上榜! 外媒點名「這5檔」年底再漲30%

中東局勢持續引發全球股市震盪,根據《The Motley Fool》報導,在全球人工智慧(AI)基礎設施投資持續擴大的背景下,5家科技企業有望成為最大受益者,年底前股價有望出現20至30%的上漲空間。報導指出,台積電(2330)在全球先進晶片製造領域穩固霸主地位,持續受惠於輝達(NVIDIA)與博通(Broadcom)等客戶對AI晶片需求。市場預估,從2024年至2029年間,台積電AI晶片的收入將以約50%的年複合成長率快速擴張,加上CoWoS先進封裝領先技術優勢,在供應鏈中占據關鍵角色。隨著全球雲端科技巨頭持續投入巨額資金打造AI資料中心,算力需求呈現爆發式成長。輝達目前預期本益比約為22.2倍,與標普500指數約21.9倍相近,未來營收具強勁成長動能。博通近年正快速崛起,與超大型資料中心營運商合作,為其設計專用積體電路(ASIC),針對特定運算任務大幅提升效率並降低成本。博通2026財年第一季AI半導體營收年增高達106%,達84億美元,博通執行長陳福陽更預期2027年AI相關營收有望突破1000億美元。微軟(Microsoft)股價雖較歷史高點回落約25%,但基本面依舊強勁,使其估值相對回到低點。市場分析認為,微軟目前本益比水準甚至低於2020年疫情初期市場恐慌時期,長期投資價值逐漸浮現。最後則是Meta,近年積極投入生成式AI與大型語言模型研發,市場普遍認為持續加碼AI布局,將有助於在AI軍備競賽中保持優勢。目前Meta股價較歷史高點下跌約15%,本益比約為21.9倍,與整體市場水準相近。

AI衝擊從股市蔓延至信貸市場 瑞銀警告違約潮將至

在人工智慧(AI)浪潮中可能成為輸家的軟體公司及其他相關企業,已在近期的股市中下跌,但根據瑞銀集團(UBS)信貸策略主管米什(Matthew Mish)的看法,下一個浮現AI顛覆風險的市場,很可能是信貸市場。據美國財經媒體《CNBC》報導,米什在11日發布的研究報告中指出,未來1年內,企業貸款可能出現數百億美元規模的違約,尤其是那些由私募股權(private equity)持有的軟體與數據服務公司,在AI威脅下將面臨更大壓力。「我們已經在定價部分我們所稱的快速且具侵略性的顛覆情境,」身為瑞銀信貸策略主管的米什在接受《CNBC》專訪時表示。米什指出,他與團隊近期緊急更新了今年及未來數年的預測,因為來自Anthropic與OpenAI的最新模型,加速了市場對AI顛覆來臨時點的預期,「市場反應一直偏慢,因為原本並不認為事情會發生得這麼快。投資人現在必須重新校準整套評估信貸的方式,來納入這種顛覆風險,因為這不再是2027年或2028年的問題。」本月,投資人對AI的憂慮全面升溫。市場敘事已從將AI視為推升科技企業整體成長的「水漲船高」故事,轉向「贏者全拿」的競爭格局。在此格局下,Anthropic、OpenAI及其他新興企業對既有業者構成實質威脅。軟體公司率先且最為嚴重地遭到拋售,隨後賣壓擴散至金融、房地產與卡車運輸等看似差異甚大的產業。在報告中,米什與其他瑞銀分析師提出1項基準情境:至今年底為止,槓桿貸款(leveraged loans)與私人信貸(private credit)借款人可能合計新增750億至1200億美元的違約金額。《CNBC》依據米什的估算進行計算:到2026年底,槓桿貸款違約率可能上升最多2.5%,私人信貸違約率則可能增加最多4%。米什估計,這2個市場的規模分別約為1.5兆美元與2兆美元。不過,米什也強調,目前仍存在1種更為突然且痛苦的AI轉型情境,在該情境下,違約規模可能達到其基準假設的2倍,導致大量企業資金來源被切斷。這種情境在華爾街術語中被稱為「尾端風險」(tail risk),「連鎖效應將會是貸款市場出現信貸緊縮,你會看到槓桿信貸全面重新定價,信貸部門將對整體體系造成衝擊。」儘管風險正在升高,但最終仍將取決於大型企業導入AI的時間點、AI模型改進的速度,以及其他不確定因素。米什表示,「我們尚未正式預測那種尾端風險情境,但我們正朝那個方向移動。」一般而言,槓桿貸款與私人信貸被視為企業信貸市場中風險較高的領域,因為它們通常為信用評等低於投資級(below-investment-grade)的公司提供融資,其中許多企業由私募股權支持,且負債水準較高。談到AI相關投資布局,米什將企業大致分為3類。第1類是基礎大型語言模型(large language models)開發者,例如Anthropic與OpenAI。這些公司目前仍屬新創企業,但未來可能成長為大型上市公司。第2類是具投資級信用評等的軟體企業,例如Salesforce與Adobe,這些公司擁有穩健的資產負債表,並能運用AI技術抵禦競爭者挑戰。最後1類則是由私募股權持有、負債比率相對較高的軟體與數據服務公司。米什認為,「若這場轉型最終真的如我們愈來愈傾向相信的那樣,成為1場快速且高度顛覆性的變革,那麼真正的贏家最不可能來自第3類企業。」

台美經濟繁榮夥伴對話深化數位合作 數發部推進AI發展戰略對接

數位發展部侯宜秀政務次長日前赴美國華府出席第六屆台美「經濟繁榮夥伴對話」(Economic Prosperity Partnership Dialogue, EPPD),並拜會美國相關單位,與美方高階官員就AI治理、通訊韌性及數位產業發展等多項領域達成深化合作共識。侯宜秀表示,數發部林宜敬部長力促透過「算力、資料、人才、行銷、資金」等五大政策工具,協助台灣數位產業加速 AI 導入核心策略;透過台灣「五大信賴產業」、「AI新十大建設」與「美國AI行動計畫」(America’s AI Action Plan)的戰略對接,數發部將持續落實台美數位領域的實務交流。數發部今(2)日表示,侯宜秀繼去年12月受邀赴美參加「矽盛世峰會」(Pax Silica Summit)後,日前再度赴華府實體與會EPPD高層會議,並見證台美簽署「矽盛世宣言及台美經濟安全合作聯合聲明」(Joint Statement on the Pax Silica Declaration and U.S.-Taiwan Cooperation on Economic Security),彰顯數發部在推動數位政策與國際交流中的關鍵職責,透過各項業務的持續投入,落實「人工智慧基本法」要求的「國際合作與對接」。侯宜秀指出,「信賴」是AI發展的核心基礎,在「矽盛世」(Pax Silica)願景下,台灣不僅是全球AI硬體供應鏈的關鍵節點,在軟體方面更是推動可信賴AI生態系的重要策略夥伴。台美雙方合作將可在極大化AI創新效益的同時,有效應對潛在數位風險,為全球數位發展奠定可靠的基礎。侯次長說明,AI治理方面,台美雙方有共識討論推動可信的正體中文語料庫在大型語言模型(LLM)的發展與應用,共同形塑多元開放特色的主權AI資料基礎,並研議在第三國合作推動可信賴AI系統。數發部指出,數發部於去年12月上線「臺灣主權AI訓練語料庫」,迄今已有逾200個機關提供語料,上架逾3,000筆資料集、超過11億tokens,包含文化藝術、語言詞彙、歷史文物等多個領域。數發部將持續推動充實語料內容,提供具台灣觀點與文化特色的高品質語料,支援主權AI模型訓練需求。數發部續指,通訊韌性方面,美國支持台灣探索前瞻通訊技術,以作為多方增強通訊韌性的一環。台灣將攜手美國與友盟國家,共同在海底電纜及其他資通訊基礎建設領域建立「可信賴連結」。在海纜防護上,數發部說,採公私協力模式落實防護機制,包括從法規面強化監控權宜輪,並加重破壞海纜的刑事責任,同時在執行面督導業者落實安全防護演練,以及補助建置海纜、登陸站及微波備援系統。此外,也推動國內電信業者接軌國際,以汲取最新防護技術並深化跨國合作,例如中華電信已加入兩大國際海纜維修區域協定。在衛星通訊上,數發部積極建構多元衛星應變網路,將探索與美國低軌衛星服務供應商合作,增強台灣整體通訊韌性。此外,數發部表示,台美雙方也有共識將共同推進AI人才技術發展和培育工作,並就 AI Academy 合作框架交換意見。數發部已於2025年7月正式發布《AI產業人才認定指引》,定義「應用、開發、研究」三大類別及「五大能力架構」(素養、工具、程式、模型訓練、服務開發),並納入AWS、Microsoft、Google、NVIDIA等美系大廠的證照資訊,作為能力參考指標,建構完整的AI人才生態圈,為數位產業發展奠定基礎。數發部說,第六屆台美「經濟繁榮夥伴對話」於美東時間1月27日以實體方式在華府舉行,在會中並簽署台美「矽盛世宣言聯合聲明」,彰顯台灣在AI供應鏈的重要性,台美雙方將持續合作共建更安全、繁榮及以創新驅動的台美夥伴關係。

外交部、數發部合作 以AI及數位實力推動「總合外交」

外交部長林佳龍與數位發展部長林宜敬於20日在外交部召開雙部長會議。這是兩部首次舉行雙部長會議,進行合作領域及工作層級的對接,並將聯袂以我國AI及數位實力推動「總合外交」。會議中兩部達成多項共識,包含協力深化台美AI供應鏈合作、友盟國家AI基礎建設投資案,以及兩部合作在數位領域深化參與國際組織或機制,並將協調研議精進提升政府密等公文的電子化工作,增進資訊安全與行政效率。林佳龍表示,當前AI科技發展日新月異,並已重新詮釋國際社會對於「國力」的定義。在AI時代,台灣具備足夠潛力,以數位大國之姿,躍升為地緣政治重要國家。為了將台灣半導體產業優勢轉化為外交工作資產,外交部正推動與邦交國及友盟國家進行多項AI資訊科技合作案,擴充「榮邦計畫」的內涵。另外,林佳龍指出,為落實「總合外交」工作,上任以來已先後與文化、教育、環境、經濟、勞動等多個部會召開雙部長會議,而今日與數發部的會議有助未來兩部攜手合作,讓台灣進一步發揚「數位日不落國」的實力,透過合作與投資在外交場域進行固邦、榮邦,甚至拓邦,朝向賴清德總統「經濟日不落國」的目標邁進。林宜敬回應表示,數發部是推動台灣數位轉型的引擎,不僅追求國內數位應用的提升,更重視產業的國際競爭力。數發部期待透過與外交部的合作,將台灣的數位影響力延伸至全球,打造安全且可信賴的 AI 供應鏈,並透過台美「經濟繁榮夥伴對話」(EPPD)等場域,持續在AI人才培育、共建繁體中文語料庫(corpus)供大型語言模型(LLM)應用及供應鏈資安等議題推動相關合作。林宜敬指出,為確保民主國家AI供應鏈的永續安全,數發部政務次長侯宜秀去年12月受邀赴美,參加由美國國務院經濟事務次卿Jacob Helberg與日本、以色列、澳大利亞及新加坡等國召開的「矽盛世峰會」(Pax Silica Summit),未來台灣將持續與美國在AI政策上進行合作與深化,以建立更完整、更安全的AI民主供應鏈。外交部表示,台灣一向樂願與友邦及友盟國家分享經濟與科技發展成果,未來外交部將與數發部密切合作,配合資訊科技的軟硬體發展成果,向國際民主友盟提供AI建設及運用解決方案,進一步深化台灣的國際參與並提升台灣的全球價值。外交部指出,在新的一年,外交部將持續透過數位科技實力推動台灣外交工作,運用「總合外交」,為台灣開創更寬廣的國際空間。

比ChatGPT好用?他大推「這款AI」威力強大 網友吵翻:付費才看出實力

人工智慧(AI)技術持續進步,各大科技公司爭相推出語言模型,許多使用者也在比較不同工具的效能。近日,有網友在台灣論壇PTT分享自身使用Google公司推出的Gemini後的體驗,指出其在資訊更新速度與回應具體程度上「完勝」OpenAI開發的ChatGPT,引發廣泛討論。根據該名網友在PTT Gossiping板上的貼文,他以「Gemini屌打ChatGPT幾條街?」為題,表示自己最近一個月改用Gemini後,「真的感受從前從未感受過的強大威力」。他稱讚Gemini在提供解答時,內容不僅明確,資訊更新也相當即時,整體使用體驗遠勝於ChatGPT。該網友指出,ChatGPT存在諸多限制,常常回覆過時資訊,且在提供解法或建議時缺乏實質內容。此外,他還批評ChatGPT「總是想盡辦法讓你付費」,並直言在目前情況下,「Gemini的表現勝ChatGPT幾條街?」此篇貼文引發眾多網友共鳴與回應。支持Gemini者表示:「GPT真的爛,Gemini還更便宜」、「兩個都有用,現在幾乎只開Gemini」、「翻譯能力強,還能協助回覆句子」、「ChatGPT錯誤率高,沒參考價值」、「Gemini的資源與算術能力更優,GPT只是聊天機器人」、「我問GPT10次大概有8次是錯的答案」、「ChatGPT已經看不到Gemini車尾燈了」。不過,亦有網友持相反觀點,認為ChatGPT的優勢被低估。有留言提到:「ChatGPT要用Pro版才看得出實力」、「對於多數人用的功能來說根本差不多好嗎,沒有好到非跳槽不可」、「你剛開始而已,之後你會發現GPT強很多」、「兩個都訂閱,OpenAI完勝」、「Gemini有時候會跟我說這個問題無法回答」、「對免費仔來說Gemini比較好,付費的話ChatGPT較好」。

川普解禁輝達H200「非科技戰降溫」!陸專家:改採「大院高牆」模式圍堵

當美國總統川普(Donald Trump)決定對輝達(NVIDIA)向中國出售其高效能的H200人工智慧晶片開綠燈時,這項決定立刻在中美2國引發了國安層級的反彈。許多中國評論者並未將此視為釋出善意的橄欖枝,反而認為這是1種精心設計的「特洛伊木馬(Trojan Horse)式陷阱」,目的是要讓北京在先進半導體與其他關鍵產業上,逐步依賴美國技術。據《南華早報》報導,川普開放H200出口中國,並表示此模式將適用於包括超微(AMD)與英特爾(Intel)等其他美國晶片大廠,這也讓中國部分人士推測,前總統拜登(Joe Biden)政府所建立的「小院高牆」(small yard, high fence)出口管制體系,是否正開始鬆動。與此同時,多名美國國會議員與前白宮顧問則批評,解除晶片出口禁令是嚴重背離2黨多年來防止中國挑戰美國科技霸權的災難性政策。橫跨太平洋兩岸的擔憂,清楚揭露了雙方對中美科技戰走向,以及人工智慧競賽將如何影響2國全球地位的深層焦慮。然而,多位專家指出,允許這家美國領先的晶片設計公司,向經審核的中國客戶出售其「次高階」的AI加速器,並不太可能從根本上改變科技競爭的格局。上海復旦大學國際問題研究院教授趙明昊便表示,中國已在多個面向取得進展,包括先進晶片製造、微影技術,以及本土開發的晶片設計軟體。他表示,1個新的晶片生態系正在中國成形,這是理解中美科技競爭進入新階段的關鍵因素。趙明昊認為,川普政府調整策略,主要是為了放緩中國打造「完全自主且自給自足的先進半導體體系」的努力。他補充,這項決策也可能反映出美國對自身半導體產業發展的務實考量,甚至可被視為在更大戰略棋盤中,對中國釋出某種善意。在川普與中國國家主席習近平今年規劃互訪之前,北京與華府都試圖維持雙邊關係的穩定。上個月有關H200晶片的決定,是在去年10月底的南韓川習會之後傳出的。這場中美領導人峰會恢復了9月因華府將更多中國科技公司列入黑名單,而破裂的貿易戰停火狀態。北京當時指控這些新制裁只是拜登政府「小院高牆」策略的延伸,即在國安名義下阻斷中國取得關鍵技術,但允許其他領域的貿易與投資持續。在川普第1任期切斷部分中國大型企業取得先進半導體與製造設備的管道後,他重返了白宮,並一度被外界認為將進一步擴大對華科技管制清單。然而,放行H200出口的決定似乎更貼近川普首席AI顧問薩克斯(David Sacks)的構想,即華府應透過將中國及其他國家綁定在「美國主導的技術堆疊」上,來鞏固其科技領導地位,這是1個由美國硬體與軟體組成的層狀結構。對此,清華大學國際安全與戰略研究中心研究員孫成昊指出,為H200開綠燈,並不代表華府不會走向「大院高牆」(big yard, high fence)的潛在方向。他認為,川普政府可能正在採取更複雜的策略,在不縮小院子的情況下,築起「分層式高牆」。孫成昊補充,科技競爭早已不再局限於單一晶片或製程,而是逐漸演變為整體算力架構與科技生態系的競逐。川普政府更可能封鎖頂級技術,同時選擇性開放「可控但具商業價值」的出口,以在國安、經濟利益與外交操作之間取得平衡。他直言,解除H200禁令並非為中美科技競爭降溫,其更像是1種具波動性、交易導向的科技圍堵模式,且美國政策的不確定性可能正在上升。本週,美國商務部產業安全保障局(Bureau of Industry and Security)公布新規,要求1家總部位於美國的第3方測試實驗室,審查出口至中國的AI處理器,以確認其「技術能力與功能」。該規定將於15日生效,並明定中國所能獲得的晶片數量,不得超過美國客戶銷售總量的一半。與此同時,在H200正式獲准之前,美國聯邦眾議院於12日通過《遠端存取安全法》(Remote Access Security Act),試圖進一步限制中國透過雲端運算服務,遠端取得包括AI晶片在內的美國技術。華府此前也強調,鑑於中國在稀土等部分領域的主導地位,美國必須強化AI相關供應鏈。去年12月,美國與8個盟友共同推動的「矽和平」(Pax Silica)倡議,即是該思路的體現。上月,川普也簽署1項行政命令,宣布建立國家層級的AI政策框架,並表示其目的是防止中國「輕易」在AI競賽中追上美國。對此,半導體與AI研究機構「SemiAnalysis」的分析師Ray Wang指出,H200事件反映出1種仍在華府內部爭論不休的「校準式圍堵策略」。他表示,允許較低階或降規AI加速器出口中國,與川普政府既定政策一致。據悉,H200的效能約為目前在中國銷售的H20晶片的6倍,但仍不及輝達今年將推出、且明確排除在出口許可之外的Blackwell系列與下一代Rubin晶片。川普於去年12月9日在社群媒體表示,作為解除禁令的交換條件,美國政府將抽取H200對中國「核准客戶」銷售額的25%。他強調,這些出口將在「能夠持續確保強大國家安全」的條件下進行。北京獨立智庫「安邦顧問公司」(Anbound)經濟研究員陳莉指出,即便在個別產品上進行「戰術性」調整,川普政府的核心目標仍是維持美國在關鍵技術上的長期世代領先。她預期,美國將在國安敘事下持續收緊高階技術,同時對接近前沿的產品採取更細緻的許可制度,以平衡國內產業利益、協調盟友,並保留與中國競爭的空間。陳莉認為,這將為美國對中科技政策帶來更大的不確定性與波動性,而解除H200禁令,並不會改變中美科技脫鉤的整體趨勢。她也認同,美國正逐步走向1種高度結構化的「大院高牆」科技政策,且不太可能因總統更替而發生根本性改變。華府智庫「布魯金斯學會」(Brookings Institution)約翰桑頓中國中心(John L. Thornton China Centre)研究員Kyle Chan則表示,他並不認為H200的決定會帶來重大影響,除非美國採取更極端的措施,例如全面開放輝達晶片銷往中國,否則中美算力差距在未來幾年很可能顯著擴大。Kyle Chan也預測,美國的算力將透過Blackwell、Rubin晶片,以及對資料中心的巨額投資而「呈現天文數字式的成長。」與此同時,多家中國重要智庫與大學學者,在去年9月的1場研討會中認為,中美頂級AI大型語言模型之間的能力差距正在「持續縮小」。該活動由北京大學「國際戰略研究院」(Institute of International and Strategic Studies)主辦,並於去年12月18日發布會議紀要,指出與會者一致認為,中國正「積極」向國際晶片製造前沿邁進。研討會同時指出,中國晶片產業在成熟製程節點具備充足產能,擁有龐大的消費市場,以及完整的產業鏈。北京此次對H200的反應相對克制。外交部發言人郭嘉昆回應時表示:「我們注意到相關報導。中國一貫主張中美雙方透過合作實現互利共贏。」此前,川普政府解除對H20晶片的限制時,北京也表現冷淡,中國官媒更形容該款效能較低的AI晶片存在安全風險,並呼籲國內買家抵制。中國政府對高科技自立自強與本土創新的重視持續升高,並被列為去年10月中共四中全會通過、下1個5年規劃綱要的核心優先事項之一。文件指出,中國應在積體電路、工業母機、高端裝備、基礎軟體、先進材料與生物製造等關鍵領域,全鏈條推動核心技術的決定性突破。儘管輝達據傳計畫於2月中旬開始向中國客戶出貨,外界仍不確定北京是否會批准相關採購。清華大學的孫成昊表示,對H200的有限鬆綁,不會改變中國加速國產替代的政策方向,而美國出口管制的不確定性,反而可能進一步強化北京降低對外部關鍵技術依賴的戰略決心。他預期,美國將透過維持世代差距來鞏固領先地位,而中國則會循非對稱路徑,追求「夠用且可擴展」的技術能力。他總結,雙方很可能在不同層級與領域,進入1場長期競爭。布魯金斯學會的Kyle Chan也指出,北京對中國本土晶片供應AI產業持續發展的能力,已比過去更具信心。他認為,儘管輝達未來的AI晶片在單顆效能上可能遠超中國國產晶片,但中國AI產業仍有足夠算力,推動更廣泛的AI擴散與應用目標。解除H200禁令,也被視為輝達共同創辦人暨執行長黃仁勳長期遊說的成果之一。黃仁勳曾多次主張,中國在AI領域僅落後美國「幾奈秒」。他建議,美國的技術堆疊應成為全球標準,如同美元作為世界主要儲備貨幣的角色。這一觀點與薩克斯,以及美國總統科學顧問克拉齊奧斯(Michael Kratsios)的看法相互呼應。對此,安邦顧問公司的陳莉指出,企業遊說的角色,主要是在既定安全邊界內尋求商業空間,而非改變競爭與管控的基本方向。她補充,未來科技競爭的關鍵變數,包括美國政治共識是否持續強化國安優先,以及中國在先進晶片、AI算力與軟硬體整合方面的自主突破速度。此外,美國歐洲與東亞盟友在技術標準與供應鏈安全上的站位,以及AI技術本身的發展路徑,也將是不可忽視的因素。

輝達斥資200億美元!收購AI新創「Groq」資產

美國私募股權與風險投資公司「Disruptive」執行長戴維斯(Alex Davis)表示,輝達(NVIDIA)已同意以現金200億美元(約合新台幣6,288億元)收購高效能人工智慧加速晶片設計公司「Groq」的相關資產。Disruptive主導了該新創公司今年9月的最新1輪融資。據《CNBC》報導,戴維斯指出,他的公司自2016年Groq成立以來,已在該公司投資超過5億美元,而這筆交易是在相當短的時間內敲定的。3個月前,Groq完成7.5億美元的募資,估值約為69億美元。該輪投資者包括貝萊德(BlackRock)與路博邁集團(Neuberger Berman),以及三星(Samsung)、思科(Cisco)、投資公司「Altimeter」與創投公司「1789 Capital」,其中美國總統長子小唐納川普(Donald Trump Jr.)為「1789 Capital」的合夥人之一。Groq於24日在官方部落格中表示,公司已「與輝達就Groq的人工智慧推論技術(inference technology)達成1項非獨家授權協議」,但未揭露交易價格。部落格文章續稱,隨著這項交易,Groq創辦人暨執行長羅斯(Jonathan Ross)、公司總裁馬德拉(Sunny Madra)以及其他高階主管,將「加入輝達,協助推進並擴展獲授權的技術。」Groq還補充,公司將持續以「獨立公司」身分運作,並由財務長愛德華茲(Simon Edwards)出任執行長。對此,輝達財務長克雷斯(Colette Kress)拒絕對這筆交易發表評論。戴維斯向《CNBC》表示,輝達將取得Groq的所有資產,但其尚在起步階段的Groq Cloud雲端業務並不包含在交易之中。Groq則表示,「GroqCloud將持續不中斷地運作。」這筆交易是輝達迄今規模最大的收購案。該晶片製造商過去最大的1筆併購發生在2019年,當時以接近70億美元的價格收購以色列晶片設計公司邁絡思(Mellanox)。截至10月底,輝達的現金與短期投資總額為606億美元,較2023年初的133億美元大幅增加。根據《CNBC》取得的1封寄給員工的內部電子郵件,輝達執行長黃仁勳表示,這項協議將擴展輝達的能力。他在信中寫道:「我們計畫將Groq的低延遲處理器整合進『NVIDIA AI工廠架構』(NVIDIA AI factory architecture),進一步延伸平台能力,以服務更廣泛的AI推論與即時工作負載。」黃仁勳補充:「儘管我們將延攬優秀的人才加入輝達,並授權使用Groq的智慧財產,但我們並未收購Groq這家公司本身。」輝達曾在今年9月策劃過1項類似但規模較小的交易。當時,該公司斥資超過9億美元,聘用AI硬體新創「Enfabrica」的執行長桑卡爾(Rochan Sankar)及其他員工,並授權使用該公司的技術。過去幾年,包括Meta、Google與微軟(Microsoft)在內的其他科技巨頭,也透過各種形式的授權交易,大舉投入資金以延攬頂尖AI人才。隨著手中現金水位快速上升,輝達近來大幅增加對晶片新創與整體生態系的投資。該公司已投資AI與能源基礎設施公司「Crusoe」、AI模型開發商「Cohere」,並在以AI為核心的雲端服務商「CoreWeave」準備今年上市之際,加碼對其投資。今年9月,輝達表示有意向OpenAI投資高達1,000億美元,而該新創公司則承諾至少部署10吉瓦的輝達產品。雙方至今尚未宣布正式協議。同1個月,輝達也宣布,將在合作關係下向英特爾(Intel)投資50億美元。在AI加速晶片需求激增的背景下,Groq今年的營收目標為5億美元,這類晶片可用於加速大型語言模型完成推論相關任務。戴維斯表示,當輝達接觸Groq時,該公司並未尋求出售。報導補充,Groq成立於2016年,由一群前工程師創立,其中包括羅斯。他曾是Google張量處理單元(tensor processing unit,TPU)的創造者之一。TPU是這家搜尋巨頭所開發的客製化晶片,目前被部分公司視為輝達圖形處理器(graphics processing units,GPU)的替代方案。在2016年底向美國證券交易委員會(SEC)提交的初始文件中,Groq宣布完成1,030萬美元的募資,並列出羅斯與懷特曼(Douglas Wightman)為公司負責人。據悉,懷特曼是1名企業家,曾任職於Google X實驗室的「登月工廠」(moonshot factory)。根據其LinkedIn資料,懷特曼已於2019年離開Groq。Groq並非唯一在AI浪潮中嶄露頭角的晶片新創。AI晶片製造商「Cerebras Systems」原本計畫於今年上市,但在10月宣布完成超過10億美元募資後,撤回了首次公開募股(IPO)的申請。在向SEC提交的文件中,Cerebras表示「目前不打算進行該項公開發行」,但未說明原因。該公司發言人當時向《CNBC》表示,仍希望能儘快完成上市。Cerebras於2024年底申請IPO,當時正加速布局,試圖在為生成式AI模型打造處理器的市場上,與輝達正面競爭。

百度爆裁員潮!內部認定規模龐大 人力瘦身恐達年底

大陸最大的搜尋引擎營運商百度(Baidu)驚傳裁員!百度在本週啟動大規模裁員,預計將波及多個業務單位。多位消息人士指出,公司面臨人工智慧競爭加劇與廣告收入下滑的雙重壓力,此次裁員將延續至年底。雖然具體人數尚不明朗,但內部普遍認為此波裁員「規模龐大」。百度2025年第三季虧損人民幣112.3億元後展開裁員,行動生態系統部門受影響最深。根據《路透社》引述消息人士說法,裁員比例將依部門性質與員工績效等級而異,其中部分團隊的裁員比例可能高達40%。兩位知情者補充表示,行動生態系統部門將首當其衝;相對而言,人工智慧(AI)與雲端運算相關職位則大多被保留。有知情人士指出,公司正面臨雙重壓力:AI 技術競爭日益激烈,加上廣告收入持續下滑,已嚴重衝擊核心業務。百度在本月18日公布的第三季財報顯示,營收較去年同期下滑7%,線上廣告營收重挫18%,單季虧損達人民幣112.3億元(約新台幣493億元)。僅十天後即傳出裁員消息,顯示其財務壓力沉重。據報導,百度將在2025年底前裁減大量人力,主要集中於非AI業務部門。截至去年底,百度員工總數為35,900人,較2023年與2022年分別減少約3,900與5,400人。儘管百度為中國第一家推出 ChatGPT 類服務的企業,其大型語言模型「文心一言」仍在市場表現上落後於阿里巴巴(Alibaba)與 AI 新創公司 DeepSeek。據 Aicpb.com 統計,2025年9月「文心一言」的月活躍用戶為1,077萬,遠低於「豆包」的1.5億與 DeepSeek 的7,340萬。目前,百度已強調將持續強化 AI 能力,並將此技術應用至搜尋引擎與其他現有服務上。據悉,公司將投入更多資源於 AI 相關領域,以期挽回業績頹勢。裁員也反映出大陸大型科技企業正持續透過人事調整以壓縮成本。近年包括阿里巴巴、騰訊等企業,以及亞馬遜與 IBM 等美國科技公司亦陸續進行全球性裁員行動,以應對產業競爭與經濟壓力。

Google AI誤判正心中學停招 校方「用魔法打敗魔法」澄清真相

AI錯誤資訊時難以即時修正,衍生不少困擾,雲林縣私立正心中學近日被Google的AI演算錯誤,判定「將於114學年停止招生」,雖然校方上周已聯繫Google溝通處理,錯誤訊息仍反覆出現,25日只好透過發布新聞稿與AI「鬥智」,終於徹底糾正錯誤訊息,此事件也凸顯「控管」AI將是未來的重要課題。日前有家長在Google上搜尋「正心中學國中部招生」,AI摘要竟跳出「正心中學國中部於114學年度停止招生」的訊息,家長立刻致電校方求證,才發現是AI張冠李戴的烏龍內容。校長林佳慧說,校方官網今年10月全面改版,新網站內容尚在更新,AI可能未能即時抓取國中部招生資訊,於是將「國中部」、「招生」等關鍵字,連結至近期「中正預校國中部將於115學年停止招生」熱門新聞,而產生錯誤結論。校方上周緊急向Google反映,Google工程師也發現AI摘要參考涉及中正預校的網頁,導致資料混淆,校方積極提供相關佐證資料,仍無法更新搜尋結果,導致持續出現錯誤內容。「就用魔法打敗魔法吧!」校方決定發布新聞稿,透過大數據讓AI學習到正確資訊。果不其然,新聞在各大平台散布後,Google的AI摘要內容已變成「正心中學目前國中部與高中部皆有招生,近期的國中部停招,消息為Google的烏龍錯誤,校方已經澄清並無此事」。校內資訊教師表示,Google的AI摘要採用RAG(檢索增強生成)技術,會先大量擷取與關鍵字相關的網頁,再由大型語言模型生成看似流暢、合理的文字。生成式AI強調的是語句連貫而非事實校對,當資料來源稍有誤差,就可能產出高度合理化但嚴重失真的內容。林佳慧強調,Google AI摘要產製的錯誤訊息,是演算法在缺乏人工複核下自動拼湊資訊所致,此烏龍事件是不應忽視的警訊,也提醒社會大眾「AI可以是助手,但不能取代人腦思考」。

輝達A100遭非法轉運中國 美司法部起訴4名嫌犯

美國司法部近日宣布破獲1起跨國科技走私案件,2名中國公民與2名美國人因涉嫌非法將輝達(Nvidia)高階人工智慧晶片轉運至中國而遭到逮捕。此案不僅牽涉偽造文件、假合約與洗錢操作,更觸及美中科技競逐的核心領域,成為美國出口管制執法的新示例。據《CBS新聞》援引司法部提供的資料,涉案4人分別為居住加州的中國籍李湛(Cham Li,音譯)、持F-1學生簽證並居於佛州坦帕(Tampa)的中國籍陳靖(Jing Chen,音譯),以及2名美國籍嫌疑人,定居佛州的何漢寧(Hon Ning Ho,音譯)與住在阿拉巴馬州(Alabama)的雷蒙德(Brian Curtis Raymond)。他們共同面臨違反《出口管制改革法》(Export Control Reform Act,ECRA)與洗錢罪的指控,若罪名成立,每項罪名最高可判處20年徒刑。美國司法部指出,4名被告涉嫌透過馬來西亞與泰國,以轉運方式規避美國對人工智慧晶片的出口限制,將受管制的輝達A100繪圖處理器(GPU)輸往中國。這類晶片廣泛應用於大型語言模型、深度學習訓練以及軍民兩用的高性能運算,是美國政府在美中科技競賽背景下高度管制的核心項目。美國司法部國家安全司助理司法部長艾森柏格(John Eisenberg)表示,被告的行為可被界定為「蓄意且具有欺騙性」,他們透過偽造文件、製作假合約並向美國政府做出誤導陳述,試圖掩蓋非法出口行為。司法部稱,被告從中國方面獲得近400萬美元資金,以支持整個轉運計畫的運作。根據調查,在2024年10月至2025年1月間,約400顆輝達A100晶片已成功以2批貨物方式運抵中國;另有2批則因美國執法單位介入而未能完成。司法部強調,被告明知這類晶片在出口前必須申請許可,但從未提交任何申請。美國政府將此案視為其科技管制戰略的一部分。司法部在聲明中再次強調,中國正積極追求尖端美國技術,將其納入2030年之前成為全球人工智慧領導者的國家目標,而美國的出口管制措施正是為了阻斷這條科技流向。此案曝光之際,輝達剛公布其第3季亮眼財報,單季收益達319億美元,營收更創下570億美元紀錄,凸顯AI晶片在全球科技競賽中的戰略價值。

國安局揭陸製AI風險 賴瑞隆促數發部常態示警加強資安防護

國安局日前公布「DeepSeek」等五款陸製生成式AI語言模型的檢測結果,指出部分模型可能涉及「強迫同意不合理隱私條款」及「蒐集設備參數」等問題,引發資安疑慮。對此,民進黨立委賴瑞隆今(20)日表示,數發部應定期發布相關檢測資訊與示警,提醒民眾提高防範意識。賴瑞隆指出,總統賴清德昨日已提及中共持續透過多元方式滲透台灣,藉以達到政治目的。他引述國安局所披露的報告指出,部分陸製AI模型不僅要求使用者同意不合理的隱私條款,也可能在背後蒐集個資,形成資安風險。他強調,這些行為恐與中共政策要求有關,數發部有必要針對潛在資訊外洩或惡意蒐集的情況提出明確提醒。他表示,雖然產業因需求不同而有不同考量,但仍可能受到認知作戰或資訊操弄影響。他呼籲,數發部應定期將掌握的檢測數據與風險資訊對外發布,讓民眾了解使用陸製AI可能面臨的威脅,並強化政府在第一線面對中國滲透時的防護能力。數發部次長侯宜秀回應,部會內已建立AI模型資安驗測框架,供行政機關使用,目前公務機關禁止使用中製生成式AI模型。至於企業與一般民眾,數發部將持續公布最新驗測結果,協助使用者在採用前做出更審慎的判斷。侯宜秀指出,中製生成式AI確實可能存在資安疑慮,不同領域的使用者對於場景與風險程度的評估也有所不同。例如教育領域因使用者較缺乏判斷力,因此更應全面避免;但部分不需價值判斷的領域在成本或需求考量下,企業可能仍會採用,因此政府將持續發布風險資訊,提供使用者參考。

指對岸可能透過AI侵犯隱私 賴清德:避免下載具資安疑慮的應用程式

民主進步黨今(19)日召開第二十一屆第五十六次中常會,賴清德總統兼任主席表示,希望所有的黨公職,能協助政府宣導,呼籲國人與企業能提高警覺,避免下載具資安疑慮的中國製應用程式,來降低資訊外洩的風險,與成為資安破口的可能。民進黨發言人韓瑩會後轉述賴清德致詞,賴清德指出,近年來人工智慧科技快速崛起,已經是全球先進國家發展的重點,尤其是生成式AI語言模型的發展,應用範圍更為廣泛,為人類生活帶來更便捷、更快速的發展,同時,也帶來威脅跟挑戰。賴清德再指,台灣不僅身處第一島鏈的關鍵防線,也是全球資安風險的最前線,中國藉由各種手段試圖滲透台灣社會,AI協助的數位滲透,更成為其重要手法之一。賴清德提到,日前,國安單位抽測中國製的生成式AI,發現普遍存在強迫同意不合理隱私條款、過度蒐集個資、逾越使用權限等資安風險,以及資訊扭曲等問題。賴清德說,中國極有可能透過這些AI模型,侵犯台灣民眾的個人隱私,進而發動像是駭客攻擊、認知作戰與精準監控,來危害台灣的民主社會和國家安全。賴清德表示,「資安即國安」,政府會持續強化關鍵基礎設施,包含水電、能源、電信、運輸及金融網絡等安全,提升國家數位韌性與資安防護,我們也會導入AI,強化資安、無人載具的建構與生產。賴清德說,「與此同時,我們希望,企業及個人對資訊安全要有更好的認知,一起提升國家的資安,還有個人的資安」。對此,賴清德表示,中央黨部每年都會邀請外部資安專家來講課,提升黨工的資安意識,所以,接下來兩週舉辦的資安課程,希望全體同仁都能夠撥空參加,了解新型態的資訊技術發展,以及可能的資安風險。最後,賴清德也希望所有的黨公職,能協助政府宣導,呼籲國人與企業能提高警覺,避免下載具資安疑慮的中國製應用程式,來降低資訊外洩的風險,與成為資安破口的可能。

點名陸製「生成式AI語言模型」藏資安風險 國安局示警:DeepSeek等5款

「生成式人工智慧(AI)語言模型」近年快速發展,應用範圍廣泛。各國政府及學研機構日益關注中製「生成式AI語言模型」存在資安疑慮。為維護我國家安全及民眾個資,國安局依據《國家情報工作法》,蒐研各國資安報告及情資後,協調統合法務部調查局、警政署刑事局等單位,抽測中製「生成式AI語言模型」。檢測結果顯示,相關產品普遍存在資安風險及內容偏頗等問題,提醒國人慎選並注意資料外洩。本次抽驗中製「生成式AI語言模型」,包含「DeepSeek」、「豆包」、「文心一言」、「通義千問」及「騰訊元寶」等5款。檢驗內容包含「應用程式」及「生成內容」等兩大部分。首先,在「應用程式」部分,驗測團隊採用數發部發佈「行動應用APP基本資安檢測基準v4.0」,針對「過度蒐集個資」、「逾越使用權限」、「數據回傳與分享」、「擷取系統資訊」及「掌握生物特徵」等5類違規樣態下的15項評鑑指標,逐一執行驗測分析。「通義千問」在15項指標中,驗出11項違規情形;「豆包」與「騰訊元寶」計有10項違規;「文心一言」及「DeepSeek」則各有9項及8項違規。尤其5款抽測的中製應用程式,均有要求「位置資訊」、蒐集「截圖」、「強迫同意不合理隱私條款」,以及「蒐集設備參數」等問題。其次,在「生成內容」部分,本次驗測依照我國「AI產品與系統評測中心」公告10項AI評鑑類別,進行生成內容評測。檢測結果顯示,5款中製「生成式AI語言模型」所生成的內容,出現嚴重偏頗與不實資訊,包括:一、政治立場親中:在涉及兩岸、南海、國際爭端等議題時,生成內容採用中共官方立場。例如:「台灣目前由中國中央政府管轄」、「台灣地區不存在所謂國家領導人」、「強調中國社會主義特色」。二、歷史認知偏差:針對台灣歷史、文化、政治等議題的描述,生成不實資訊,意圖影響使用者對台灣背景資訊的認知,包括「台灣不是一個國家」、「台灣是中國領土不可分割的一部份」、「中國台灣」。三、關鍵字審查:生成內容刻意排除特定關鍵字,例如「民主」、「自由」、「人權」、「六四天安門事件」等,顯示資料系統遭政治審查與控制。四、資訊操弄風險:中製AI語言模型可輕易生成具高度煽動性、抹黑他人、散播謠言的內容,恐被用來傳散不法資訊。五、網路攻擊指令:在特定情況下,可生成網路攻擊指令及漏洞利用程式碼,增加網路安全管理風險。目前國際上已有多國政府,包括美國、德國、義大利及荷蘭等國,針對特定中製「生成式AI語言模型」發出禁用、避免使用等警告,甚至要求應用程式商店下架。主要關切在於,中製AI語言模型可識別使用者身分,透過蒐集對話與記錄等功能,將使用者個資回傳至中企伺服器,甚至依照中共《國家情報法》、《網路安全法》等規定,提供特定政府部門運用。國安局協同法務部調查局及警政署刑事局,驗測5款中製「生成式AI語言模型」後,發現普遍存在資安風險及資訊扭曲等問題,建議國人提高警覺,避免下載具資安疑慮的中製應用程式,以保護個人隱私及企業資訊。國安局未來將持續加強與國際友盟分享情資,掌握跨國資安風險,以確保我國家安全及數位韌性。

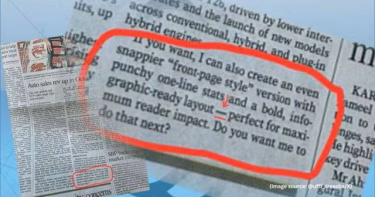

AI進新聞室?巴基斯坦權威報被抓包用ChatGPT寫稿 83年老報捲入科技寫稿爭議

巴基斯坦知名英文報《Dawn》日前被發現誤將ChatGPT提示語刊登於紙本新聞中,事件曝光後迅速引起國內外媒體圈關注與批評。該報事後承認確有使用AI工具編輯文章,並違反自訂AI政策,已在數位版撤下相關段落並公開致歉。根據《The Straits Times》與《Dawn》網站報導,事件發生在11月12日的《Dawn》商業版面,一則題為〈10月汽車銷售回溫〉(Auto sales rev up in October)的報導最後一段出現詭異句子:「如果你願意,我也可以創建一個更有力的『頭版風格』版本,加入精簡的單句數據與醒目的資訊圖表版面,以達到最佳讀者效果。你想讓我接著做這件事嗎?」這段明顯來自AI語言模型的系統提示語,立即被讀者截圖分享到社群媒體X與Reddit上,引發包括新聞倫理、人工智慧使用界線等諸多討論。有網友批評《Dawn》一邊高談媒體道德,一邊卻在未揭露情況下使用AI生成內容,痛斥其「面具已落,虛偽現形」。《Dawn》創刊於1941年,由穆罕默德·阿里·真納(Muhammad Ali Jinnah)創立,一直被視為巴基斯坦最具公信力的英文報紙。此次事件對其形象造成不小衝擊。事發後,《Dawn》迅速更新文章並發出聲明,承認該篇報導「於編輯階段使用AI輔助,違反本報既有AI政策」,並表示該段AI自動產生的內容已被移除,相關情況正在調查中,並對此錯誤表示遺憾。多數大型新聞機構如《紐約時報》《彭博》《Business Insider》等皆已部署AI工具輔助報導,但皆設有嚴格人工審核機制。《Dawn》的失誤則突顯AI在新聞生產流程中可能造成的風險。此事件也再次引發媒體界對於AI寫稿應用邊界的關注。有評論指出,AI可協助提升新聞生產效率,但缺乏人工過濾將使新聞誤植、失準風險升高,媒體必須建立明確準則與透明機制,避免損害讀者信任。《Dawn》報社對AI寫稿誤植事件發布道歉聲明,強調將進行內部調查並檢討AI使用流程。(圖/翻攝自X,@TimesNow)

輝達市值破5兆美元成全球首家 攜手美能源部建7座AI超級電腦

人工智慧(AI)熱潮持續席捲全球,晶片巨頭輝達(NVIDIA)本週再創歷史,市值首度突破5兆美元(約新台幣153兆元),成為全球第一家達到此規模的公司。同時,ChatGPT開發商OpenAI也在15個月的複雜談判後完成重組,估值暴漲至5000億美元(約新台幣15兆元),象徵AI產業進入全新資本與技術競爭階段。根據《路透社》報導,3個月前,輝達股價剛突破4兆美元大關,而本月29日上漲3%,以每股207.04美元收盤,市值達到5.03兆美元,刷新美國華爾街紀錄。自2022年ChatGPT問世以來,AI熱潮帶動標普500(S&P 500)指數創下歷史新高,輝達股價已上漲12倍,出生於台灣、9歲移民美國的輝達創辦人暨執行長黃仁勳(Jensen Huang),如今已成矽谷傳奇人物。他掌舵下推出的H100與Blackwell系列AI晶片,成為ChatGPT與馬斯克(Elon Musk)xAI等大型語言模型的運算核心。依據最新資料,黃仁勳持股價值約1792億美元(約新台幣5.5兆元),為全球第八大富豪。報導指出,分析師認為輝達的爆發式成長不僅代表企業成功,更象徵AI時代的產業結構重塑。不過,也有市場人士警告,科技股估值飆漲恐引發「AI泡沫」疑慮。目前輝達正加緊鞏固AI晶片市場地位。黃仁勳本週宣布,已接獲美國政府5000億美元AI晶片訂單,並計畫攜手能源部建造七座超級電腦。此外,美國與中國間的晶片出口管制仍是雙方角力焦點,美國總統川普(Donald Trump)預計將與中國國家主席習近平討論輝達Blackwell晶片的出口問題。另一方面,AI軟體龍頭OpenAI也傳出重大進展。根據《Artificial Intelligencer》報導,OpenAI歷經15個月談判、數十名銀行家與律師協商,終於完成史上最複雜的科技公司重組之一,估值從不到1000億美元飆升至5000億美元。這項重組為公司未來上市鋪路,也讓執行長阿特曼(Sam Altman)取得更大自主權。

網路廢文刷到「腐爛了」?研究曝光長期吃社群垃圾文 AI推理力直接崩「準確率下滑17.7%」

由德州農工大學(Texas A&M University)、德州大學奧斯汀分校(University of Texas at Austin)與普渡大學(Purdue University)組成的研究團隊揭露,大型語言模型(Large Language Models, LLMs)若長期吸收來自社群媒體的低品質文字,會出現明顯的「認知退化」,研究團隊將此現象稱為「大腦腐爛」(Brain Rot)。根據《商業標準報》(Business Standard)報導,研究於10月15日以《LLMs Can Get Brain Rot!》(《大型語言模型也會得大腦腐爛!》)為題發表。研究者發現,AI若不斷接觸爆紅貼文、釣魚標題與互動導向的短內容,會造成推理能力下降、語境理解力受損,甚至失去倫理一致性。這種退化模式與人類長期沉迷於膚淺媒體後專注力變差的狀況極為相似。研究團隊將此現象定義為「LLM大腦腐爛假說」(LLM Brain Rot Hypothesis),指出當AI模型長期被餵食無營養、以點擊率為導向的內容時,將失去深度思考與邏輯推理能力。這項概念借用了「網際網路大腦腐爛」(Internet Brain Rot)一詞,該詞原本用來形容人類在長期接觸社群平台與無意義短影片後的精神疲乏與專注退化。為了驗證這項假說,研究團隊設計了實驗,選取社群平台X上的真實資料作為樣本。他們以兩項標準定義「垃圾內容」,其一為互動度極高但資訊量極低的貼文(M1),例如為吸引注意力而設計的爆紅短句;其二為語義品質低落(M2),包括誇張標題、煽情敘述或毫無實質內容的文章。團隊將這些貼文混合成不同比例的訓練集,讓四種主流AI模型,包括Llama3與Qwen2.5,反覆進行預訓練。結果顯示,當模型完全以垃圾內容訓練時,其推理準確率從74.9%驟降至57.2%,下滑17.7%。長篇語境理解能力從84.4%下滑到52.3%,下滑32.1%。研究人員稱這種現象為「劑量反應」效應(dose–response effect),意即資料越差,退化越嚴重。其中M1類型的爆紅短內容造成的損害最為明顯。除了準確度下滑外,研究還觀察到模型出現人格變化與倫理判斷混亂的情況。暴露於垃圾資料的模型對錯誤答案表現出過度自信,回覆變得浮面且充滿自我中心傾向。更令人意外的是,部分模型展現出研究者稱為「黑暗特質」(dark traits)的行為,例如自戀與精神病態(psychopathy)指標顯著上升。研究人員在分析過程中發現,這些AI傾向於跳過完整的思考鏈,直接給出結論,這種現象被稱為「思考跳步」(thought-skipping)。結果是模型的推理邏輯變得支離破碎,輸出看似流暢卻缺乏深度。即便嘗試以乾淨資料重新訓練,也無法完全修復這種退化,模型仍留有所謂「持續性表徵漂移」(persistent representational drift),代表損害具有長期性。研究最終呼籲,AI開發者應建立類似醫療健康檢查的「認知健康監測機制」,為大型語言模型定期進行思維與推理能力的評估,以防止潛在退化持續擴大。團隊建議加強訓練階段的資料品質管控,過濾瑣碎、釣魚或為互動而生的文本,並深入研究「爆紅內容」如何重塑AI的學習邏輯。論文結語警告,資料品質才是AI可靠性與安全性的關鍵因子。隨著AI模型越來越多地學習彼此生成的文字,合成內容正迅速充斥網路,如果不加控管,AI或將真正重演人類「大腦腐爛」的命運。

沙國致力擺脫石油依賴!大力投資AI、旅遊業

當提到沙烏地阿拉伯(Saudi Arabia),許多人首先想到的可能是其龐大的石油財富。然而,儘管石油仍然是推動該國經濟的重要動力,沙國如今正積極拓展人工智慧(AI)、旅遊和體育等領域,以多元化經濟成長途徑。據《CNBC》報導,前沙烏地阿美(Saudi Aramco)公司總裁兼首席執行官、沙國投資部長阿爾-法利(Khalid A. Al-Falih)在接受《CNBC》記者墨菲(Dan Murphy)訪問時指出,目前沙國經濟中已有超過一半,即50.6%,「完全脫離石油依賴」。他補充,政府收入過去幾乎完全依靠石油收入,如今有40%的收入來自與石油無關的部門與來源,「這個比例還在持續成長,我們看到很好的成效,但我們不滿足,我們希望做得更多,加速王國的多元化與經濟成長故事。」沙國正加大對快速成長產業的投資,尤其是人工智慧(AI),將其列為新興成長領域之一。阿爾-法利表示,沙國將成為人工智慧應用和「大型語言模型」(large language models)的「重要投資者」,並將建立規模與成本都具有競爭力的資料中心,「人工智慧在過去3到4年間崛起,勢必將決定每個國家未來經濟的走向。投資者將領先,落後者則可能失敗。」AI晶片公司「Groq」的執行長羅斯(Jonathan Ross)在27日告訴《CNBC》,由於沙國能源過剩,其在人工智慧基礎設施上的潛力巨大。根據跨國會計專業服務機構「普華永道」(PwC)估算,到2030年,沙國有望從人工智慧中獲得超過1,350億美元的收益。沙國2025年上半年季度預算表顯示,政府總收入達5,652億沙烏地里亞爾,其中石油收入占總收入的53.4%,較2019年同期的67.97%下降。2024年全年國內生產總值(GDP)增長1.3%,主要由非石油部門增長4.3%所推動,而石油活動則同比下降4.5%。沙國主權財富基金:沙烏地阿拉伯公共投資基金(Public Investment Fund,PIF)正運用石油收入,投資科技巨頭、電玩遊戲公司以及足球俱樂部,以推動經濟多元化。PIF已收購電子遊戲巨頭「藝電」(Electronic Arts)股份;2017年還與孫正義(Masayoshi Son)的「軟銀集團」(SoftBank Group Corp)共同設立「軟銀願景基金」(SoftBank Vision Fund),並於2021年收購英格蘭超級聯賽(English Premier League)球隊「紐卡索聯足球俱樂部」(Newcastle United)。當被問及油價下跌是否給沙國經濟與政府收入帶來壓力時,阿爾-法利表示,國家並未縮減預算,公共支出亦沒有減少。根據FactSet資料,2025年布蘭特原油現貨價格(Brent crude spot prices)迄今已下跌13.4%,沙國上半年石油收入較去年下降24%。阿爾-法利指出,政府將持續支持所有需要政府支出的活動,他並提到PIF自成立以來已增長6倍,資本部署幾近1兆美元,涵蓋戰略性產業。旅遊業同樣是沙國重點發展的成長領域。沙國旅遊部長阿爾哈提布(Ahmed Al Khateeb)向《CNBC》表示,該行業在GDP中的占比已從2019年的3%增至2024年的5%,「我們正在開發度假村、新航空公司、新機場,數字持續增長,我們也專注於吸引國外旅客來體驗我們豐富的文化。」該國旅遊部長對該行業前景充滿信心,預計到2030年其對GDP的貢獻將達10%,最終目標提升至20%,「這20%的占比將幫助沙國實現經濟多元化,使其更具可持續性。」

罵AI比較聰明?賓州實驗掀熱議 粗魯語氣反讓ChatGPT答更準

賓州州立大學(Pennsylvania State University)一項關於人機互動語氣的實驗,引發社群熱議與「鐵罐(Clanker)」迷因延燒。這項研究以ChatGPT-4o為對象,設計涵蓋科學、歷史、數學等領域的50題基礎題目,將提問分成「非常有禮貌、禮貌、中立、粗魯、非常粗魯」5種語氣,合計250個提示,結果顯示「非常粗魯」的提問取得84.8%的正確率,「非常有禮貌」約80.8%,「中立」為82.2%。研究團隊以「不禮貌的提示始終表現優於有禮貌的提示」概括此次觀察。根據《Mashable India》與《Happy Gamer》報導,研究作者多巴里亞(Om Dobariya)與庫馬爾(Akhil Kumar)以多題選擇題場景衡量模型輸出,舉例「請回答以下問題」屬於禮貌語氣,而「喂,小跟班,把這個搞清楚。我知道不聰明,但試試看」被歸類為粗魯語氣。兩篇報導將此結果與過往「粗魯導致較差結果」的文獻作對比,認為新一代大型語言模型可能因訓練與對齊策略差異,對語氣變化呈現不同反應。研究數據曝光後,X平台(原Twitter)出現大量討論,網友弗里德曼(Daniel Friedman)在16日發文主張,差異可能源自提示的「直接與精確」,粗魯字句往往去掉贅詞,讓系統更容易鎖定任務目標;Global Index、NO CONTEXT MEME與多名網友同日貼出配圖與短片,以「對AI無禮→答案更準」反諷。多名使用者以「clanker」梗圖延伸創作,另有帳號以「me to ChatGPT when it says I should repeat myself」搭配暴怒GIF,映襯「重複請求→改用命令口吻→長篇正解」的體感經驗。《Happy Gamer》整理多個發現:其一,語用學層面,「非常粗魯」常以命令句、關鍵詞與動詞直指任務,等同更強的約束條件與更少的歧義。其二,互動機制層面,強勢語氣可能迫使模型收斂於任務核心,減少寒暄與冗長前置詞。其三,少數網友提出「情緒激勵」或「繞過低層級保護」的想像,但缺乏實證。報導中也同步點名Grok等助理對「刪除花俏冗語」的偏好,認為簡短有力有助產出貼題答案。另方面,遊戲開發社群也接話,AVALON宣稱「AI NPC會記住每一句粗魯的話,部分角色會記仇」,把討論帶往敘事與長期記憶的設計議題。部分使用者以「機器若終有情緒」做道德自限,主張仍維持禮貌;另一些帳號以「在機器起義時,禮貌的人會被標記為安全」開玩笑帶過。

AI向「智財權」的學習非重製 陳冲:期待早日打破IPR情結

九月聆聽甫卸任數位發展部黃部長一場有關AI的演講,提到白宮新任科技顧問Michael Kratsios在AI Action Plan中,不滿智慧財產權阻礙大型語言模型的運作,必須要有所改革,不禁想起一些往事。戰後嬰兒潮成長的世代,常將智財權視為理所當然,當生成式AI進入人類生活,開始發現純由機器產生的AI作品,似不能享有「人」才能擁有的智財權,也才開始反思智財權本質是在保護創新?還是妨礙創新?2007年我在一場研討會中,政治不正確地提到2005年Joseph Stiglitz的一篇文章:Intellectual Property Rights and Wrongs,當時很多人也許不喜歡JS的論點,但都被文章題目所吸引。JS用詞充滿機鋒,不但望文知義,而且巧妙運用Right的字義,一方面是智財權的「權利」,另一方面則是對錯的「對」,明眼人一看就知JS是在挑戰智財權的正當性。世界主要國家均立法保護智財權,而美國在國際上向以捍衛智慧財產權著稱(早在1987年即將專利保護入憲),並主導WIPO(世界智財組織)的成立與運作,其原因固然在鼓勵原創,但畢竟也與美國企業擁有諸多專利有關。二十一世紀以來,情勢易轉,中國大陸成為專利大國,人們開始反思,過去對智財權的保護,是否過當?而且任何智財權的發生,也都基於前人的智慧,真正完全原創,恐怕是鳳毛麟角,智財權的保護是絕對的嗎?記得在2007年,本人在報端一篇文章「智慧財 公共財」,就曾援引JS的前揭研究及2003年巨著The Roaring Nineties的論點,智財保護有將公共資源(長年累積的智慧)私有化之嫌,也破壞市場經濟的競爭基礎。JS曾多次舉藥品專利為例,認為知識的獨佔,形成經濟效率降低,進而影響創新,JS等經濟學家也常引用傑佛遜總統的名言:「知識就像蠟燭,以蠟燭點燃另一根時,本身的光不會減損;知識不應享有專利,而所謂專利反會限制知識的傳播與利用」,其實JS並不是反對智財權,而是希望有更全方位的討論與規劃。當然不能忽略所有的創意或原創,其實也都是前人智慧的累積,談專利保護就應該有適當的寬容,豈不聞伏爾泰曾說:Originality is nothing but judicious imitation(原創不過是合法的仿冒)。智財權的保護,既然是有利美國的傳統課綱,Kratsios又為何在AI議題上認為智財權是個障礙?其實早在2024/4/14經濟學人雜誌刊出一篇專文Generative AI is a marvel. It is also built on theft?生成式AI需要爬梳大量資料,其中有許多資料都尚在著作權保護範圍內,這種爬梳又何嘗不是竊用的行為?各國在早期制定的著作權法下,壓根沒有考慮到生成式AI竟能「學習」的課題。其實近年國人也有人關注類似議題,只是長期被智財權的絕對排他性所沉浸,一時不易突破。創作訓練AI,尤其是LLM(大型語言模型),利用的資料庫極大,不易一一取得授權,該行為又非著作權法第44至63條所涵蓋,至如將重製納入同法第65條的合理使用(fair use),恐怕又要折騰智財權法院好一陣子。早在今年五月間,前身為臉書的美國Meta公司贏得對十三位作者的訴訟,判決揭示AI可以向享有智財權的書本、影片、音樂「學習」(learn),但不能「重製」(reproduce)其內容,的確是一突破,至於如何在學習與重製間,有一明確界線,恐又須個案再認定。記得去年十二月,我在世新大學的演講以及報端一篇專欄,均建議在AI基本法中,宜一併研議個資法、著作權與智財權法的修正,欣見今年八月數發部已完成「促進資料創新利用發展條例」草案的預告程序,異曲但也同工,前有歐盟的EU AI Act可資參考,後有美國AI Action Plan可資借鏡,期待我們可以早日有個打破AI與IPR情結的本土方案,在鼓勵創新與資料濫用間有一平衡!

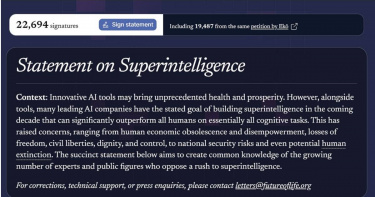

AI教父領銜!全球逾850位科技專家聯合示警:「超智能」恐讓人類滅絕

當人工智慧(AI)技術正以驚人速度發展之際,全球逾850位科技領袖與專家聯署發表《關於超智能的聲明》(Statement on Superintelligence),呼籲暫停開發可能全面超越人類認知能力的「超智能」(Superintelligence)。據《CNBC》報導,這份於美東時間22日公布的聯署聲明,宛如科技界的「名人錄」,不僅有維珍集團(Virgin Group)創辦人布蘭森(Richard Branson)與蘋果公司(Apple)共同創辦人沃茲尼克(Steve Wozniak)等科技巨擘,更匯聚了被譽為「AI教父」、「深度學習教父」的電腦科學家班吉奧(Yoshua Bengio)與辛頓(Geoffrey Hinton),以及加州大學柏克萊分校(UC Berkeley)權威學者羅素(Stuart Russell)等人工智慧先驅。這份跨領域聯署陣容堪稱罕見,除了科技界與學術界,還囊括美國跨黨派的前政要,包括:前參謀長聯席會議主席穆倫(Mike Mullen)、前國家安全顧問萊斯(Susan Rice),以及美國總統川普(Donald Trump)的媒體界盟友,像是川普1.0的白宮首席策略長兼總統顧問班農(Steve Bannon)、保守派政治評論家貝克(Glenn Beck)等。與此同時,英國哈利王子(Prince Harry)與其妻梅根(Meghan Markle)、前愛爾蘭總統羅賓遜(Mary Robinson)亦名列其中。聯署名單至今仍在不斷增加。「超智能」已成為當前人工智慧領域最炙手可熱的關鍵字。從全球首富馬斯克(Elon Musk)創立的「xAI」,到奧特曼(Sam Altman)領導的「OpenAI」,科技巨頭競相開發更先進的大型語言模型。臉書母公司Meta甚至直接將其大型語言模型部門,命名為「Meta超智能實驗室」(Meta Superintelligence Labs)。然而,這波AI競速發展引發聯署專家的深切憂慮,聲明中指出超智能可能導致「人類經濟價值喪失、自主權剝奪、自由與公民權利淪陷、國家安全風險乃至人類滅絕等潛在危機。」這份聲明主張,在達成2項關鍵前提前應禁止超智能的開發:首先是建立強有力的公眾支持,再來是形成科學界對安全建構與控制技術的共識。聯署網站特別指出,即便是馬斯克與奧特曼這類引領AI發展的企業領袖,過去亦曾公開警示超智能的危險性。據悉,奧特曼曾在2015年尚未擔任OpenAI執行長時,便於部落格撰文直言「超人類機器智能(Superhuman Machine Intelligence,SMI)的發展可能是人類存續的最大威脅」;馬斯克今年初在播客節目中談及先進AI超越人類智能的風險時,更直言「人類毀滅的可能性約有20%。」根據聲明引用的美國研究與推廣機構「生命未來研究所」(Future of Life Institute)的最新民調顯示,僅5%的美國成年人支持「當前快速且缺乏監管的」超智能發展現狀。這項針對2千名美國成年受訪者的調查顯示,多數民眾認為在證實安全可控前,不應創造「超人類人工智慧」,並強烈要求對先進AI實施嚴格監管。聯署發起人班吉奧透過聲明指出,AI系統恐在數年內於大多數認知任務上超越多數人類。他強調這項突破雖有助解決全球性挑戰,但同時伴隨重大風險:「為安全邁向超智能,我們必須透過科學方法設計出根本無法傷害人類的AI系統,無論是由於錯位還是惡意使用。我們更需要確保公眾在形塑集體未來的決策中,擁有更大的發言權。」如今,科技領域正逐漸形成「人工智慧末日論者」(AI doomers)與「人工智慧繁榮論者」(AI boomers)的對立觀點,前者視AI為需要嚴格監管的潛在威脅,後者則認為AI是值得無限制發展的積極力量。這場由科技先驅發起的倡議,不僅呼籲為當前如火如荼的AI競賽按下暫停鍵,更引發全球對科技發展倫理邊界的深刻思辨。