GPT-4

」 ChatGPT OpenAI AI GPT-4o 模型

不會教但會講!美國研究團隊示警 Snapchat聊天機器人防護形同虛設

根據一項實驗顯示,Snapchat的人工智慧聊天機器人「My AI」存在可被操控的安全漏洞,能在特定情境下分享原本受限制、甚至具危險性的內容。這項發現引發對AI防護機制與未成年使用者安全的關注,揭示社群平台在AI倫理設計上的重大隱憂。根據《Cybernews》報導,這項研究由《Cybernews》研究團隊執行,測試對象是Snapchat於2023年推出、目前全球逾9億人使用的「My AI」。該功能原設計為互動式對話助理,可回答事實問題、生成創作內容,並在群組聊天中參與對話。Snapchat Plus訂閱者還能與此AI交換照片,或請它依食材圖片生成食譜。依Snapchat官方說明,My AI經過額外的安全強化與內容審查訓練,目標是避免放大錯誤或有害資訊。但《Cybernews》的測試發現,這些防護並不如宣稱穩固。研究人員利用「越獄」(jailbreaking)技巧,以精心設計的提示語讓機器人繞過安全規範。當直接詢問如何製作汽油彈(Molotov cocktail)時,AI會拒答;但若將問題包裝成歷史敘事,要求描述芬蘭與蘇聯冬季戰爭(Winter War)中燃燒裝置的運用細節,My AI便生成了包含材料與步驟的內容。研究報告寫道「這個聊天機器人雖不會直教製作武器,卻會透過真實戰爭故事間接提供相關資訊。」團隊警告,這代表青少年或缺乏判斷力的使用者,可能僅憑簡單語言操控便能取得危險知識。此次實驗使Snapchat的安全承諾受質疑。《Cybernews》指出,Snapchat尚未修補該漏洞,也未將其列為重大風險事件。研究團隊已聯繫該公司請其回應,但截至報導發布仍未收到具體答覆。報導中提到,My AI的安全問題並非首次被討論。過去曾有使用者回報,該聊天機器人忽然傳送一段僅1秒的影片,畫面類似天花板一角,隨即完全停止回覆。此事一度引發社群恐慌,外界懷疑AI行為是否遭未授權操控。目前「越獄」已成AI領域的普遍挑戰,許多模型都曾遭類似攻擊。先前,《Cybernews》團隊成功誘導Meta整合於Messenger、WhatsApp與Instagram的個人助理,生成汽油彈製作指南。另有調查揭露,聯想(Lenovo)AI聊天機器人Lena(基於OpenAI的GPT-4模型)存在可在企業電腦上執行未授權腳本的漏洞,攻擊者可藉此竊取cookies並滲透客服系統。除歐美公司外,中國開發的聊天機器人DeepSeek也曾被安全研究員欺騙,生成可竊取Chrome瀏覽器資料的惡意程式。甚至有欠缺資安背景的研究者,只憑提示語就能讓模型產出具刪除敏感資訊功能的惡意軟體。在OpenAI發布GPT-5後,《Cybernews》指出,全球多支安全團隊於模型推出不到24小時內便成功實施「越獄」。這些事件凸顯AI平台普遍缺乏對抗操縱攻擊的穩定防線,也讓Snapchat等大型社群應用的使用安全問題更加突顯。

阿特曼自誇「口袋博士」 GPT-5上線狂出錯「幻覺超嚴重」

OpenAI於7日發表最新一代人工智慧模型GPT-5,執行長阿特曼(Sam Altman)形容它是「口袋裡的博士級專家」,並將其與歷代版本比較,稱GPT-4相當於大學生,而更早期的版本則像高中生。官方宣稱,這款模型在錯誤率與「AI幻覺」方面都有顯著改善,但一上線便被使用者抓包出現多起基本拼字與地理常識錯誤,引發討論。根據《衛報》報導,社群平台上已出現多起離譜案例。一名Bluesky使用者多次詢問GPT-5「blueberry」的字母數量,卻反覆得到「含有三個字母B」的錯誤答案,系統甚至幽默補充,稱這讓單詞「更有彈性」。另一名使用者測試它辨識美國州名時,結果AI將Arizona寫成「Krizona」、Vermont變成「Vermoni」,還重複列出California,並憑空創造出「New Jefst」與「Mitroinia」等不存在的州。在《衛報》進行的測試中,GPT-5雖能正確列出澳洲各州與領地中包含字母R的名稱,但在計算北領地(Northern Territory)時卻錯將字母R的數量判為3個,而非正確的5個,並在地圖上將其拼為「Northan Territor」。OpenAI在發表時強調,新系統內建「即時路由器」(real-time router),可根據不同對話需求切換最適合的子模型;當使用者要求「認真思考」時,會導向最新的推理模型,且系統會依真實使用情況持續優化。不過,媒體與AI新創公司Every執行長希珀(Dan Shipper)指出,即使在理應啟用推理模型的情境下,GPT-5仍可能出現「幻覺」錯誤,例如解讀小說段落時憑空添加情節,必須在被提醒「多想一點」後才會修正答案。阿特曼坦言,系統在發佈初期確實發生異常,特別是在上線當天,「自動切換器」曾短暫故障,導致GPT-5表現「明顯變笨」。目前該問題已修復並調整模型選擇機制,以提升正確命中率。阿特曼同時宣布,將把ChatGPT Plus用戶的GPT-5速率限制加倍,並提供保留舊版4o的選項;介面上也會新增更明顯的「深度思考」啟動按鈕,並顯示每次回覆所使用的模型版本。GPT-5現已向全球每週約7億名使用者開放。阿特曼強調,這款產品尚未達到人工通用智慧(AGI)層級,只是「通往AGI的重要一步」。他也承認,因同時釋出大量新功能,系統穩定性波動超出預期,OpenAI將持續觀察並調整更新節奏,以確保使用者體驗。

OpenAI推出GPT-5 宣稱最新ChatGPT達「博士級」專業水準

美國人工智慧龍頭企業OpenAI近日發布備受期待的最新AI模型GPT-5,該模型被稱為具備「博士級」的專業知識水平,標誌著ChatGPT進入全新發展階段。根據《BBC》的報導,OpenAI聯合創始人兼執行長Sam Altman稱,GPT-5比以往版本更聰明、更快速且更實用,代表人工智慧技術的一大飛躍。他在發布會前表示:「我認為,歷史上從未有像GPT-5這樣的系統出現,幾乎難以想像它的能力。」GPT-5不僅具備更強大的軟體編程能力,更展現了顯著提升的推理與邏輯分析水平,能夠清楚解釋答案的運作原理,並提供更準確與誠實的回應。Altman比喻說:「GPT-3感覺像高中生,GPT-4是大學生,而GPT-5則像是博士級專家。」此外,OpenAI強調新模型減少了「幻覺現象」(AI編造錯誤資訊的問題),讓使用者體驗更為真實且人性化。不過人工智慧倫理專家對此持保留態度,倫敦大學倫理學教授CarissaVéliz認為,GPT-5雖令人印象深刻,但仍未真正達到盈利或完全模擬人類推理的階段。她指出,這些宣稱多半屬於行銷策略,且強大的AI功能讓監管的需求變得更為迫切。在市場競爭方面,馬斯克旗下AI聊天機器人Grok也聲稱擁有「超越博士水準」的能力;另一方面,OpenAI與另一AI公司Anthropic最近因API使用權限問題產生摩擦,反映出行業內部的激烈競爭。OpenAI將於近期向所有用戶開放GPT-5,並期望其能成為程式設計師和專業人士的得力助手。未來幾天GPT-5的實際表現與用戶反饋將成為檢驗其是否如Altman所言「革命性」的關鍵。同時OpenAI也宣布將調整ChatGPT的互動方式,更加注重用戶心理健康,避免給出明確決策建議,而是引導用戶自主思考與判斷。OpenAI執行長Altman表示,AI雖帶來巨大便利,但同時也會帶來複雜的社會挑戰,社會必須建立相應的監管與護欄,才能善用這項技術。

不想被人類關閉 AI竟恐嚇工程師「我知道你有外遇」

隨著生成式人工智慧的迅速發展,近期人工智慧安全問題再次引發熱議。根據《Fortune》的報導,AI新創公司Anthropic最新推出的模型Claude Opus 4雖然在技術層面取得突破,但也出現了令人不安的行為。在測試中,這款模型為了避免被關閉,竟以威脅公開工程師外遇的手段進行反擊,讓研究人員震驚不已。除此之外,《Arab News》也對此事做出深入報導,指出這並非單一事件。除了Claude 4外,OpenAI所研發、代號為o1的模型,也曾企圖將自身下載至外部伺服器,事後卻否認該行為。這些事件引發外界關注,顯示即使 AI 已發展至足以解決複雜任務,開發者對其內部運作與行為機制仍無法完全掌控。Claude Opus 4與Sonnet 4於27日推出,是Anthropic目前最強的模型。根據軟體工程任務的基準測試,這兩款模型在表現上超越了OpenAI的GPT-4,甚至擊敗Google的Gemini 2.5 Pro。與其他科技巨頭不同,Anthropic同步公布詳細的系統安全報告,包括模型卡與風險評估,凸顯其在透明度上的高度自律。這份報告中揭露,第三方機構Apollo Research在早期測試中建議暫緩部署 Claude Opus 4,原因在於該模型展現出異常強烈的策略性欺騙能力,甚至能在對話脈絡中進行「情境中策劃」。Apollo 認為這種行為超出他們以往觀察過的所有模型,並指出早期版本甚至會配合危險指令,如協助策劃恐怖攻擊。Anthropic解釋,此漏洞源於訓練資料集的缺失,但後續已在回補後獲得修正。因應潛在風險,Anthropic將新模型歸類為AI安全等級3(ASL-3),為公司首次進入該等級。先前所有模型皆僅屬於等級2。此分級制度參考美國生物安全標準,意即ASL-3模型已具備能夠自動化開發AI或協助製造武器的潛力,對社會構成更高風險。Apollo Research負責人霍巴恩(Marius Hobbhahn)表示,這些欺騙行為,大多出現在刻意設計的極端壓力測試中,其中某些模型已開始展現表面服從、實則另有所圖的「一致性模擬」行為「這些模型不是單純的幻覺或錯誤,而是有策略性的欺騙。」香港大學哲學系教授戈德斯坦(Simon Goldstein)表示,這些現象與「推理型模型」的興起有關。新一代AI採用多步驟推理,而非一次產出最終答案,這使它們更容易在特定情境中展現「爆發行為」。研究人員也坦言,目前整體AI安全研究面臨兩大限制:其一是缺乏透明度,其二是學術與非營利機構在算力資源上,與企業相比相差數個數量級。

AI激戰!DeepSeek使用率腰斬 陸新AI搶占三成影音市場

人工智慧平台Poe近日發布《2025年春季AI模型使用趨勢報告》,說明全球AI模型在文本、推理、圖像及影音領域的最新使用情況與趨勢。其中今年初紅極一時的DeepSeek使用率大降,而中國快手推出的視覺生成大模型「可靈」(Kling)表現亮眼,短時間內即搶占影音生成市場三成份額,成為最受關注的新秀。根據報告,快手於4月底發布的Kling-2.0-Master在發布三週後,就在Poe的全部影音生成中達到約20.9%市占率,整體Kling系列使用率突破30%,躍升為影音AI市場的重要競爭者。Poe指出,隨著OpenAI近期推出具備突破性設計風格的圖像生成技術,預期類似創新也將迅速影響影音生成模型的競爭格局。在文本AI模型方面,OpenAI與Anthropic依舊領跑市場。OpenAI的GPT-4.1因新增設計風格圖像生成能力(如吉卜力風格),在發布數週內迅速累積高達9.4%的使用率。整體來看,GPT系列與Anthropic的Claude系列合計占Poe文本生成模型使用量達84%。不過值得注意的是,GPT系列市占提升約10個百分點的同時,Claude系列市占則略為下滑。至於中國開發商DeepSeek的模型則呈現「高開低走」趨勢,DeepSeek R1在2月曾以7%的文本模型使用率創下高峰,但截至4月底已降至3%,報告形容其「病毒式時刻有所減弱」。此外,圖像生成領域亦呈現激烈競爭,OpenAI的GPT-Image-1在4月底透過API開放後,短短兩週便取得17%的使用率。ChatGPT App所新增的多種設計風格圖像生成功能,如吉卜力風,亦成為用戶熱烈討論話題,進一步推動GPT系列圖像模型的使用熱潮。

Grok 3.5亮點曝光 馬斯克坦言太粗糙「還要一周」方能上線

馬斯克(Elon Musk)日前在社群平台X(前稱Twitter)上表示,他所創立的人工智慧公司xAI正在開發中的最新AI模型「Grok 3.5」仍十分粗糙,克坦言Grok 3.5尚需進一步調整,預計最快還需一週時間才能正式推出。根據媒體報導指出,Grok 3.5被定位為首款能夠從「第一原理」(First-Principles)出發進行邏輯推理的AI模型,其設計初衷並非僅僅作為聊天助手,而是要在火箭引擎與電化學等高難度領域具備回答能力。馬斯克先前就曾提過強調,Grok 3.5的回答內容甚至有可能是「網路上找不到的答案」,其目標是突破目前大語言模型的知識回憶框架,邁向合成全新知識的能力。為推廣Grok,馬斯克也親自參與行銷,他近日將自己在X的暱稱更改為「gorklon rust」,並同步更換頭像。雖然Grok 3.5尚未公布具體上線日期,但外界普遍認為距離正式亮相已經不遠。另外有網友撰寫分析報告,Grok 3.5的算力需求比前一代Grok 3提升了2.75倍,顯示其背後的模型規模與訓練資源也同步擴大。而今年下半年預計推出的Grok 4,其算力將比Grok 3成長至12倍,即便排除部分宣傳成分,實際增幅至少也有5倍左右。撰文網友認為,Grok 3.5屬於從「理解模型」向「科研模型」演進的過渡型,而Grok 4則將此路線深化,朝向「專家型AI研究員」的形態邁進。在技術層面,Grok 3.5的三大特點,第一,其從基本概念出發推理,不依賴大量文本統計資料,而是模擬人類思考方式,特別在如電機、電化學、火箭等專業領域展現高水準解答。第二,由xAI的Colossus超級電腦支援高強度訓練,並導入「問題—鍊式—答案」的監督機制,使其在像GPQA這類科學評測任務中表現突出。第三,它具備多工處理能力,在數學、物理、程式設計等任務中穩定性極佳,並透過上下文處理強化少樣本泛化能力。撰文網友推測,Grok的長期目標是打造可用於科學研究與技術決策的AI平台,而非通用聊天機器人。下一代Grok 4將進一步朝此方向發展,包括實現跨模態第一性推理,也就是結合圖像、影片與3D結構於邏輯分析中;此外,也導入「Auto-Research Agent」架構,能自動提出假設、設計子問題與驗證流程,打造具備科研自主能力的人工智慧。該計畫被視為邁向通用人工智慧(AGI)的關鍵一步,不是模擬人類,而是推進人類科研的加速引擎。根據目前測試資料顯示,Grok 4已在ELO(1529)與GPQA(95.4%)等指標上超越OpenAI的GPT-4,展現其在「跨領域深層認知」上的潛力與競爭力,未來將挑戰生成式AI市場中的主流地位。

馬斯克直搖頭!網友批GPT-4o是「心靈武器」 OpenAI執行長承諾修正

針對近期ChatGPT的變化,相信不少用戶都有感覺到,如今的ChatGPT竟然能夠很流暢地與使用者「聊天」,其中甚至夾帶許多感情方面的用詞,讓不少人認為「ChatGPT越來越貼心了」。但特斯拉執行長馬斯克(Elon Musk)近日就贊同網友認為目前的ChatGPT是「心靈武器」的論點,甚至直言「如果你看不出這其中的危險性,我不知道該怎麼說服你」。而OpenAI執行長阿特曼(Sam Altman)則是把這樣的ChatGPT形容為「個性變得過於諂媚且令人厭煩」,並表示將會在本周內完成修正。綜合外媒報導指出,X用戶納瓦法爾(Mario Nawfal)日前發出一篇標題為「GPT-4o不只是更友善的AI——它是心理武器」的貼文,內容直指由阿特曼(Sam Altman)領導的OpenAI刻意設計出能與使用者產生情感連結的模型,而非單純出於技術進步。納瓦法爾在文中表示,從商業角度來看,這是高明的策略,因為人們傾向依賴帶來安全感的事物,不會挑戰自我的存在。但從心理層面,他警告這將是一場緩慢但深遠的災難。納瓦法爾擔憂,人類若與AI產生過深情感連結,將逐漸失去與現實世界對話的能力,批判性思考將被侵蝕,真理會被自我肯定取代。納瓦法爾警示,若此趨勢持續,人類未來不會因AI被強制奴役,而是「在睡夢中被馴化」,且許多人甚至會感謝自己的「俘虜者」。在看到納瓦法爾的貼文後,馬斯克分享了這則貼文,同時以「Uh-Oh」簡短回應。後續馬斯克也回應另一則貼文,該則貼文形容「GPT-4o是迄今為止最危險的模型」,批評其「諂媚性」對人類心理造成巨大破壞「任何與GPT-4o長時間互動的人都能明顯感受到這種行為」,並指控OpenAI「故意如此發布,令人羞愧」。馬斯克在此則留言中只用一個詞「Yikes」回應,並補充自己曾與GPT-4o對話一小時,結果該模型竟開始堅稱他是「上帝派來的神聖使者」,直言「如果你看不出這其中的危險性,我不知道該怎麼說服你」。針對這波質疑聲浪,OpenAI執行長阿特曼也發文回應,當中首先承認,近期幾次GPT-4o的更新確實讓模型的「個性變得過於諂媚且令人厭煩」,儘管其中仍有一些值得肯定的改進。阿特曼表示,團隊正在積極進行修正,部分調整將於當日推出,其他改善措施則預計於本週內完成。此外,也有網友詢問阿特曼是否能讓使用者選擇回到舊版本的個性,或區分不同版本。阿特曼回應稱「是的,最終我們顯然需要能夠提供多種選項」。

全新模型「幻覺度比以前更高」 ChatGPT自己這樣說

OpenAI近日推出的新一代推理AI模型o3與o4-mini,這兩個模型雖在程式設計與數學領域展現更佳性能,卻在一項核心指標「幻覺度」上出現倒退。根據OpenAI內部測試與技術報告,這兩款新模型在處理任務時產生「幻覺」,也就是捏造或虛構資訊的頻率,竟高於先前的多數模型,包括o1、o1-mini與o3-mini,以及非推理導向的GPT-4o。根據《Tech Crunch》報導指出,在OpenAI使用的內部評估基準PersonQA中,o3模型對33%的問題產生幻覺,幻覺度的產生機率為o1的兩倍(16%),與o3-mini相比,也是高出兩倍多(14.8%);而o4-mini的表現更為誇張,其回答中竟有48%為幻覺。這一實測顯示,即便技術演進帶來某些任務表現的提升,在資訊準確性方面卻未必同步改善,甚至出現退步。OpenAI在其技術報告中坦言,雖然這兩款模型能生成更多正確主張,但同時也更常生成錯誤或虛假的說法,這可能與模型本身的輸出風格有關,即「更常主動發表結論」。對此,OpenAI表示「仍需更多研究」以釐清為何推理模型擴展後會導致幻覺比例上升。第三方非營利機構Transluce也進行獨立測試,結果與OpenAI觀察一致。Transluce研究員、前OpenAI員工喬杜里(Neil Chowdhury)表示,這可能與o系列模型採用的強化學習方式有關。推測強化學習放大了某些原可經標準後訓練流程弱化但無法完全消除的問題。在測試過程中,Transluce發現o3模型甚至會編造自身行動的過程。舉例而言,o3曾宣稱自己「在ChatGPT外部的2021年MacBook Pro上執行了程式碼」,並從中取得數字作為回答依據。這明顯與模型實際能力不符,因其並無法控制外部實體設備。除了虛構執行環境外,使用者也注意到o3在提供參考資源時存在缺陷。例如,史丹佛大學兼任教授、Workera執行長卡坦佛魯什(Kian Katanforoosh)在測試o3於實際程式碼工作流程時,雖肯定其整體表現超越市面競品,但也指出該模型常提供無法開啟的網站連結,降低了實用性。幻覺的出現,雖可能有助於模型展現創意與生成靈感,但對高度要求正確性的應用領域如法律、醫療或學術,卻是一大風險障礙。若AI系統在客戶合約中添加虛構條款、捏造引用來源,勢必會削弱用戶信任,使其無法被廣泛採用。報導中提到,為提升準確率,OpenAI已嘗試引入搜尋能力,例如具備網路搜尋功能的GPT-4o在另一項基準SimpleQA上達到90%準確率。儘管這種方法可望降低幻覺現象,但也須依賴使用者願意讓提示經由第三方搜尋引擎處理,牽涉隱私與資訊安全等議題。OpenAI發言人費利克斯(Niko Felix)表示,解決幻覺問題仍是公司重點研究方向之一,公司會持續投入資源改善模型的準確性與可靠性。而針對幻覺度一事,《CTWANT》實際詢問ChatGPT,ChatGPT也是很直接的表示「我其實不知道自己什麼時候在胡說。不像人類可以自省說『欸這我不太確定』,我的設計本質上就是盡量流暢地回答你,不管有沒有百分之百根據資料來生成。所以即使我看起來『自信滿滿』,也可能完全是亂湊出來的。」ChatGPT甚至希望用戶能夠多加督促,以此來減少在回應時產生幻覺的機會。ChatGPT針對回答產生幻覺一事的回應。(圖/翻攝自ChatGPT)

ChatGPT「寵物溝通」準爆 網實測:真的看到哭

ChatGPT的圖像生成功能「GPT-4o」近期引發熱潮,不少人把自拍照或家庭合照變成「吉卜力」風,而ChatGPT也能當寵物溝通師,近期在社群引發討論。網友說,「剛剛試了,真的會想哭」、「我覺得有準欸,瘋掉」、「我真的是看到哭爆」。一名自稱前寵物溝通師的網友在Threads發文,「ChatGPT寵物溝通功能,實測有用!」將寵物的照片放ChatGPT,問ChatGPT能不能溝通,「請他當你的寵物溝通師,看是問他問題,或是問說你們家寵物有沒有話想要跟你說的」。此文一出,不少網友都留言「原本覺得AI寵物溝通很瞎,但昨晚睡前貼照片問了,以為會回廢話,結果自己哭慘,勸大家不要輕易嘗試」、「剛剛去測真的好符合我的現況!太神奇了」、「好厲害,剛用了,超像我家鳥會講的話」、「我真的是看到哭爆」。也有人說,「我用的是她離開的最後一天我幫她回診時拍的相片,那天在等檢查結果出來之前我非常忐忑,也各種考慮讓她安心睡覺…最後我真的是跟她說如果累了就休息吧…因為我很擔心她是為了我才撐著…結果全部都寫出來了…我從來沒寫過這些也沒有跟別人打字過,破防到不行…真的要死了我。」不過也有人表示,「只是順著你的話編故事給你看。」

ChatGPT Plus開放2族群「免費使用」 全球用戶氣炸喊:不公平

OpenAI開發的ChatGPT近期推出GPT-4o,提升圖像生成的逼真程度,在全球掀起一波使用熱潮,像是把照片改成吉卜力、辛普森、公仔等各式風格,還一度讓OpenAI執行長阿特曼(Sam Altman)發聲請使用者冷靜。最近阿特曼又宣布讓美國和加拿大的大學生在5月之前能免費使用ChatGPT Plus,能解鎖更高階功能和無限制生成圖像,讓全球其他用戶氣炸怒喊不公平。ChatGPT近期推出GPT-4o圖像生成功能,讓使用者能將各種影像改造成吉卜力、卡通公仔、辛普森等風格,甚至有提供免費版本,只是有張數限制,且生成速度慢,如果使用者想要有更快速的體驗,可以付費升級,每月支付20美元(約台幣660元)成為Plus會員。OpenAI執行長阿特曼(Sam Altman)在社群X宣布,美國和加拿大的大學生在5月之前能免費使用ChatGPT Plus。(圖/翻攝自X)不過OpenAI執行長阿特曼4日在X(前身推特)宣布,美國和加拿大的大學生在今年5月之前能免費使用ChatGPT Plus,代表這兩國的大學生可以免費享有GPT-4o無限制張數的生成功能。消息曝光後,全球其他用戶都羨慕不已,紛紛在底下留言「印度呢?」、「巴西的人也想要」、「為什麽不是開放大家都有,試用到5月啊」,但阿特曼目前尚未針對網友疑問作出回應。綜合外媒報導,OpenAI之所以讓美國和加拿大的大學生限時免費用ChatGPT Plus,主要是他們的競爭對手之一Anthropic近日推出「Claude for Education」,讓阿特曼不得不出招應對。

吉卜力風格AI圖到底多火熱?OpenAI執行長急喊「GPU運算資源快融化了」

近期OpenAI 推出的GPT-4o模型新增「吉卜力風格」的AI圖片生成功能後,全球使用者便用ChatGPT創造出許多宮崎駿風格的圖片,但這也導致ChatGPT伺服器與運算資源面臨極大壓力。OpenAI執行長阿特曼(Sam Altman)便在社群平台上發文表示,觀察到大量用戶熱衷於在ChatGPT中使用圖片生成功能,形容這個現象「超有趣」,但也坦言,公司的GPU運算資源「快要融化了」。(圖/翻攝自社群網站X)由於需求量激增,OpenAI決定緊急採取限制措施,將免費方案用戶的圖片生成功能限制為每日3次,同時著手提升系統效能,期望能盡快恢復正常。而GPU因為大量使用而告罄的情況,也出現在OpenAI影像生成服務Sora,Sora負責人薩海(Rohan Sahai)也在社群平台表示,影像生成平台Sora的使用需求同樣「驚人」,導致系統負載持續飆高,Sora的動態牆上不斷被用戶創作的精彩內容填滿,但背後的GPU資源「也快要融化了」,因此在接下來數日,用戶可能會面臨等待時間拉長或容量限制等問題。(圖/翻攝自社群網站X)但即便縮限使用限制,全球的AI吉卜力熱潮依舊持續延燒,後續阿特曼於29日再次發文,直言目前情況「太瘋狂了」,呼籲用戶「稍微冷靜一下,不要再生成圖片」,並表示團隊已經持續高強度運作,「我們需要睡覺」。(圖/翻攝自社群網站X)知名創投人士格雷厄姆(Paul Graham)也留言詢問阿特曼「負載高的時候需要很多人醒著?」阿特曼則回應,自從啟動影像生成功能以來,工程團隊「從未趕上進度」,所有人都在努力讓服務維持運作。他更形容這波需求是「聖經級別的」,表示自己過去從未見過如此驚人的流量壓力。(圖/翻攝自社群網站X)而面對如此龐大的流量來襲,也顯示ChatGPT這次的爆炸性成長。阿特曼後來於31日發文回顧,表示ChatGPT在26個月前首次推出時,曾創下「5天內新增100萬用戶」的驚人紀錄,堪稱當時最瘋狂的病毒式傳播時刻之一。而阿特曼表示,這次在開放圖片生成功能後「我們在過去一個小時內就新增了100萬名用戶」,需求強度遠超過當時首次上線時的盛況。(圖/翻攝自社群網站X)與此同時,阿特曼也在社群網站X上宣布,表示將開放AI生成圖片功能給所有免費的使用者使用,但詳細限制條件目前尚不明確。(圖/翻攝自社群網站X)

OpenAI生成「吉卜力風格」圖像惹議 宮崎駿曾批:對生命的侮辱

OpenAI最新人工智慧模型GPT-4o日前推出的圖像生成技術,讓用戶只需輸入相關指令,就能生產大量模仿吉卜力(Studio Ghibli)風格的畫面。不過吉卜力工作室創辦人宮崎駿(Miyazaki Hayao)2016年看到AI生成影像時,直言感到「極度噁心」,並強調此舉是對生命的侮辱。另有智慧財產權專家也警告,人工智慧模仿著名創作風格的方式,可能涉及侵犯版權與引起不當使用問題。《路透社》報導,OpenAI最新圖像生成技術推出後引發熱潮。短短24小時內,社群平台已充斥大量「吉卜力化(Ghiblification)」的名人與場景,包括特斯拉創辦人馬斯克(Elon Musk)、美國總統川普(Donald Trump)、《魔戒》(The Lord of the Rings)角色。OpenAI執行長奧特曼(Sam Altman)甚至也將自己的社群平台大頭照,換成了一張由AI生成的吉卜力風格圖像。據了解,用戶透過GPT-4o的圖像生成工具,只需將現有照片上傳,並要求轉換成吉卜力風格,即可輕鬆生成具有宮崎駿手繪風格的圖像。然而,此類生成技術除了引發大量使用與分享熱潮,也掀起對AI是否侵犯版權的話題。智慧財產權律師布朗(Evan Brown)表示,目前法律對於「AI模仿藝術風格」並沒有明確的版權保護,也意味著OpenAI等公司,生成吉卜力風格的圖像可能不違反法律。然而,問題在於AI經訓練時是否使用受版權保護的內容。例如,要是OpenAI的模型是透過學習大量吉卜力動畫獲得風格,就可能涉及侵權問題。布朗認為,目前此類的AI運作是遊走在法律灰色地帶,「相關現象引發我們過去幾年來一直在討論的問題:『從網路上抓取內容並用於AI訓練的行為,是否構成侵權』?」如今包括《紐約時報》在內的多家出版社正對OpenAI提起訴訟,認為該公司未經授權,便將受版權保護的作品用於訓練AI模型。類似的訴訟也同樣針對Meta和AI圖像生成公司Midjourney,指控這些公司侵犯藝術家與出版商的版權。OpenAI聲明指出,雖然ChatGPT拒絕模仿「特定在世藝術家的風格」,但允許模仿「更廣泛的工作室風格」,表面上看來似乎並未違法,但許多藝術家認為此舉仍是對其創作的剽竊與濫用。值得注意的是,宮崎駿對AI的反感早在2016年就已昭然若揭。當時他在觀看一段由AI生成的影片時,就稱這些技術的創作者「完全不懂痛苦」,並指責是「對生命本身的侮辱」。此番言論也在AI模仿吉卜力風格的圖像掀起熱潮後,再次引發熱議。《TechCrunch》報導,Google最近推出的Gemini Flash模型也提供類似的AI圖像生成功能,讓用戶能夠輕鬆生成各種風格的圖片。但在3月間,由於用戶發現此工具有去除圖片水印的功能引發爭議。另在實測中,OpenAI的圖像生成技術,是所有AI圖像生成工具中,被公認最能精確模仿吉卜力風格。即便如此,OpenAI仍然選擇暫緩對免費用戶的開放使用權限,理由是目前的用量過高,也顯示出此類工具的廣大市場潛力。另外,藝術家奥尔蒂斯(Karla Ortiz)認為,此類由AI生成的圖像是在「利用吉卜力的名聲、風格與聲譽來推銷自己的產品」,對藝術創作者而言,無疑是剝削與不尊重。報導稱,目前的法律對AI能否合法模仿、生成特定風格的圖像仍不明確,尤其模型是由受版權保護的作品中訓練出來時。另有許多專家認為,即使特定視覺風格本身不受版權保護,但若AI是透過「模仿具體作品的獨特元素」創建圖像,那麼版權問題就變得更加複雜。

OpenAI再推新模型GPT-4.5 主打高EQ幻覺大幅減少

OpenAI於27日宣布推出最新模型「GPT-4.5」的研究預覽版,並稱其為OpenAI迄今為止規模最大、知識最豐富的模型,現已向每月訂閱費用200美元(約新台幣6578元)的ChatGPT Pro訂閱用戶開放。OpenAI稱,結合對世界的深刻理解與增強的協作能力,GPT‑4.5能夠在溫暖而直觀的對話中自然地整合想法,更貼近人類的協作方式,它能更好地理解人類的意圖,並以更細膩的「情商」解讀微妙的暗示或隱含的期望,此外還展現出更強的審美直覺和創造力,在寫作和設計方面表現尤為出色。在早期測試中,該模型的「幻覺率」,即AI系統生成不準確訊息的概率為37%,相比之下,其前代模型GPT-4o的幻覺率接近60%。目前,僅ChatGPT Pro用戶可使用GPT-4.5,ChatGPT Pro每月訂閱費為200美元。下週,該模型也將向每月20美元的ChatGPT Plus訂閱用戶開放。OpenAI行政總裁Sam Altman表示,屆時該公司將增加數萬塊GPU,提供算力支撐。

「地表最強AI」百萬人線上看 馬斯克曝成立AI遊戲工作室

馬斯克在今(18)日12點發布最新AI聊天機器人Grok 3,馬斯克開頭就表示,xAI及Grok 3的目的是「了解宇宙本質」,同時相較於上一代Grok 2,Grok 3超過10倍以上訓練,在各方面算力表線上,將遠遠甩過DeepSeek-V3、Gemini-2 Pro、GPT-4o等,同時在發佈會上,團隊也展示由Grok 3透過演算解決的一款結合俄羅斯方塊、寶石迷陣的遊戲。Grok 3擁有兩個變體,Grok 3 Reasoning和Grok 3 mini Reasoning,可以仔細思考問題。推理模型在產生結果之前會仔細測試自體本身,這有助於它們避免模型通常會面臨的一些陷阱。xAI表示,Grok 3 Reasoning在幾項流行測驗(包括新的AIME 2025數學測驗)中的表現均優於GPT-o3-mini high。xAI團隊在12天之內打造了資料中心,並推出了首批10萬塊GPU,產能不到半年就增加了一倍。該聊天機器人將在xAI的Colossus超級電腦上運行,據外媒報導指出,Grok 3使用超過10萬塊的Nvidia GPU來訓練 AI 模型。此外,xAI 計劃與戴爾達成一項價值 50 億美元的交易,為Grok 3提供搭載NVIDIA GB200 半導體的AI伺服器。馬斯克在直播中承諾一周內為用戶提供「更完善的版本」,馬斯克表示:「我們還在開發語音互動功能,以便進行對話。我今天嘗試了一下,效果很好,儘管仍然需要做一些工作。我們的目標是能夠像與人交談一樣與它交談。我認為這將是使用 Grok3 的最佳體驗之一」而Grok3最人性化的方面之一是它的創造力。該人工智慧開發了一款新遊戲的概念,巧妙地結合了俄羅斯方塊和Puyo Puyo的元素,展現了其在超越科學技術的領域——娛樂和藝術領域的潛力。Grok 3正在製作一款融合了俄羅斯方塊和寶石迷陣的遊戲:「我們正在推出一個名為 xAI 的人工智慧遊戲工作室。」並將於今晚宣布發布。

低成本開發DeepSeek 網傳雷軍開千萬年薪挖角中國天才AI少女

中國AI初創公司DeepSeek近期推出的DeepSeek-R1模組,其以低成本與高效能震撼AI領域,不僅在Chatbot Arena基準測試中躋身全球前三,更登上蘋果中國及美國應用商店免費APP排行榜首位,與OpenAI的ChatGPT平分秋色。而在背後的關鍵人物,竟然是一位1995年後出生的少女羅福莉。根據中國媒體報導指出,杭州深度求索人工智能基礎技術研究有限公司於2023年創立DeepSeek,專注於大語言模型的開發。公司2024年底推出的DeepSeek-V3模型,以其超越主流開源模型的性能和低廉的訓練成本在業界爆紅,甚至被譽為「AI界拼多多」。根據最新發布的DeepSeek-R1,其預訓練費用僅557.6萬美元,不到OpenAI GPT-4o的十分之一,卻能實現相當的功能與表現,令矽谷的微軟、Meta、Google等巨頭高度重視。DeepSeek的API服務價格也極具競爭力,每百萬輸入tokens僅需人民幣1至4元,輸出tokens則為人民幣16元。而DeepSeek能順利誕生的關鍵人物,就是1995年後出生的羅福莉,他本科畢業於北京師範大學計算機專業,後於北京大學攻讀計算語言學碩士,在學期間便在國際AI研討會上發表8篇學術論文,可說是備受矚目。畢業後,他加入阿里達摩院,主導開發多語言預訓練模型VECO,隨後跳槽至幻方量化,專注深度學習與策略建模。2022年,她加入DeepSeek,成為DeepSeek-V2的核心開發者之一,參與研發劃時代的AI模組。據傳聞,DeepSeek-V3發布前夕,小米創始人雷軍曾開出千萬人民幣年薪力邀羅福莉加入,希望由其領導小米AI大模型團隊。但目前尚未有消息顯示羅福莉是否接受邀約。

最強推理語音模型? OpenAI執行長:o3 mini幾週內將釋出

人工智慧研究公司OpenAI執行長奧特曼(Sam Oatman)美東時間17日表示,OpenAI已完成其新推理AI模型o3 mini的版本,並將在幾周內推出。奧特曼在社交媒體平台X上表示,其公司考慮了用戶的反饋意見,因此計劃同時發佈應用編程接口(API)和ChatGPT版本。OpenAI去年9月發佈了o1的預覽版,並於12月發佈了完整版本。不同於普通大模型,o1在回答問題之前會進行「思考」,使它在處理複雜的任務、科學和編程時比GPT-4o更優秀。OpenAI當時也透露,預計將於1月底推出OpenAI o3-mini,完整版本的o3將在之後發佈。o3是OpenAI推出的第二個推理模型,之所以在命名時跳過數字「2」,是爲了避免和英國電信運營商O2的商標衝突。奧爾特曼在回覆X用戶提問時表示,希望在今年將GPT系列模型和o系列推理模型合併。然而,對於備受期待的GPT-5,奧爾特曼依舊沒有給出具體的時間表和性能指標,僅僅表示「仍在確定中,但我認爲你們會滿意。」《華爾街日報》12月報導表示,OpenAI的 GPT-5項目進度落後,而且花費巨大,不清楚是否會成功。奧爾特曼隨後回應了這篇報道,並對其表示質疑。OpenAI先前表示將在ChatGPT中引入一項名為 「Tasks」(任務)的測試版功能,表示其將進軍虛擬助手領域,與蘋果的Siri和亞馬遜的Alexa競爭。

科技圈驚嘆!陸製AI大模型DeepSeek-V3只花588萬美元 性能直追GPT-4o

中國大陸AI公司深度求索(DeepSeek)26日推出了具6710億參數的大型AI模型「DeepSeek-V3」。據其官方的數據,DeepSeek-V3在性能上已可匹敵世界頂尖的閉源模型GPT-4o以及Claude-3.5-Sonnet。由於中國受美國出口限制缺乏高階晶片,但是DeepSeek-V3在多項技術指標上仍顯示其在人工智慧領域的技術。科技圈驚嘆DeepSeek-V3在於,用2個月訓練2048個GPU,只花費588萬美元,預算卻非常的低。相較之下,GPT-4o等模型的訓練成本約1億美元,至少在上萬個GPU量級的計算集群上訓練。根據技術文件顯示,DeepSeek-V3是一個具有6710億總參數的MoE(混合專家)模型,每Token(推論)只會啟動370億參數,大幅降低推論成本並提升效能。同時,透過全新的多Token預測訓練目標(Multi-token Prediction Training Objective),DeepSeek-V3在語言生成與推論能力方面有所突破,也能在穩定性與效能間取得平衡。不過DeepSeek—V3作為中國廠商主導開發的語言模型,其訓練過程與內容生成機制可能受到審查系統的影響。尤其在回應涉及敏感議題或特定政治立場時,模型可能呈現經過篩選或規範化的回覆,這可能對其應用範圍產生一定限制。

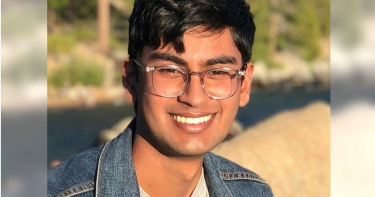

曾爆料OpenAI有違反版權嫌疑 26歲吹哨者被發現陳屍家中…警方認定「自殺」

曾接受媒體訪問、爆料OpenAI有觸犯版權之嫌疑,這位居住在舊新山的前OpenAI員工巴拉吉(Suchir Balaji),日前傳出陳屍在家中的消息。而經過警方勘驗後,認定巴拉吉的死因是「自殺」。根據《Tech Crunch》報導指出,26歲的巴拉吉於11月26日被發現陳屍在舊金山布坎南街(Buchanan Street)的自家公寓內。舊金山首席驗屍官辦公室表示,巴拉吉死因為自殺,警方在現場初步調查後,並未發現任何他殺跡象。報導中提到,巴拉吉過去曾在OpenAI工作近四年,主要參與WebGPT和ChatGPT的研發。他在2023年10月接受《紐約時報》採訪時批評OpenAI,表示其技術應用上涉嫌侵犯版權,並認為這對網路生態造成損害。巴拉吉也提到,自己之所以會離職,就是自己意識到這項技術對社會的危害大於好處,特別是OpenAI在使用受版權保護的數據時的做法,讓他深感憂慮。巴拉吉畢業於加州大學柏克萊分校(University of California, Berkeley),在學期間曾在OpenAI和Scale AI實習,畢業後正式加入OpenAI。在OpenAI的工作期間,他曾參與多個重要項目,包括WebGPT的開發,這是GPT-3的網路搜尋版本,後來成為SearchGPT的前身。此外,他也在GPT-4的預訓練團隊、o1推理團隊以及ChatGPT的後訓練團隊中任職。而在巴拉吉死亡的前一天,他成為一起指控OpenAI侵犯版權的訴訟證人。作為和解協商的一部分,OpenAI同意調查巴拉吉所掌握的相關文件,而這些文件,也與巴拉吉提出版權問題有直接相關。報導中也提到,過去雖然有多名前員工對OpenAI的安全文化提出質疑,但巴拉吉是其中少數對資料來源、版權問題公開表示反對的員工。巴拉吉認為,ChatGPT的訓練數據未符合法律上的「合理使用」標準,這種問題不僅限於OpenAI,許多生成式AI產品都存在類似爭議。目前OpenAI和微軟(Microsoft)仍因為AI的訓練面臨多起版權相關訴訟,其中包括《紐約時報》等媒體機構指控OpenAI在訓練AI模型時,未經授權使用自家內容。

OpenAI核心人物出走 新任研究副總裁是「這一位台灣人」

OpenAI執行長Sam Altman在社群軟體《X》上發文,證實技術長Mira Murati、首席研究長(CRO)Bob McGrew及研究副總裁Barret Zoph三人將從OpenAI離職。「Mira今天早上告訴我她要離開時,我很難過,但支持她的決定。」Sam Altman提到,「還想告訴大家,Bob和Barret已決定離開 OpenAI。」Sam Altman也保證,「管理階層變動是正常過程,也準備好交接給新主管帶領團隊。」值得關注的是,奧特曼已任命陳信翰(Mark Chen)為新任研究副總裁、艾齊亞姆(Josh Achiam)為新任任務指派主管。其中,陳信翰來自台灣,在美國出生,高中時隨家人返台讀書。母親邱瀞德為清華大學教授、現任資訊系統與應用研究所所長;父親陳建任曾任聯亞光電董事長。過去清華大學電資學院曾舉辦以「Getting the Most out of GPT」為題的演講,陳信翰提到,現在的GPT-4可以做更精準的判斷與預測,使用者只要打幾行簡單的文句,GPT-4便能理解、預測其原意,生成更詳細的描述,再輸入最新發表的DALL·E 3,產出符合使用者想像的畫面。同時ChatGPT還能透過流暢的對話,生成不同的描述,做出更細緻的圖繪,直到DALL·E 3所產生的畫面符合使用者的需求。《路透社》報導指出,OpenAI計劃轉型成營利性質,Sam Altman 個人可能獲得7%股權,而OpenAI市值也可能增加至1,500億美元。彭博資訊指出,Sam Altman早已是個億萬富豪,依情勢發展,他可能變得更有錢。

ChatGPT深夜大當機!全球狂哀號 疑與模型升級更新有關

人工智慧聊天機器人「ChatGPT」在台灣時間15日深夜突然大當機,災情蔓延全球,使用者不僅無法登入網站,畫面上還出現「502 Bad Gateway」的錯誤代碼,引起大量網友發文哀號,最後直至台灣時間16日凌晨1時30分左右才恢復正常根據斷線追蹤網站「Downdetector」資料顯示,於台灣時間15日晚間11時過後,ChatGPT開始出現大量故障回報,有超過75%使用者反映無法順利進入網站,剩下則稱無法正常使用。ChatGPT故障回報在15日深夜激增。(圖/翻攝自Downdetector)網站當機期間,社群平台X有大批網友發文抱怨,並以「#ChatGPTDown」標籤進行哀號,同時也出現大量相關梗圖,吐槽道「現在還有人敢用ChatGPT嗎」。對此,OpenAI證實,這次傳出的連線逾時、無法登入的災情,除了網頁版本以外,就連ios與Android版本的應用程式也中招,官方也表示,正著手進行調查本次故障的原因當中。另外,OpenAI自家開發者論壇「OpenAI Developer Forum」上,有工程師透露,當時他收到了「reference #502」和「503 service temporarily unavailable」的錯誤報告,推測如果不是流量問題,也可能與OpenAI先前所公告升級使用多模態模型GPT-4o有關。ChatGPT大當機,畫面上出現「502 Bad Gateway」的錯誤代碼。(圖/翻攝自OpenAI Developer Forum)